Biais

Les outils d’IA contre le cancer peuvent déduire la démographie des patients, soulevant des inquiétudes sur les biais

Rapporté par l'IA Image générée par IA Vérifié par des faits

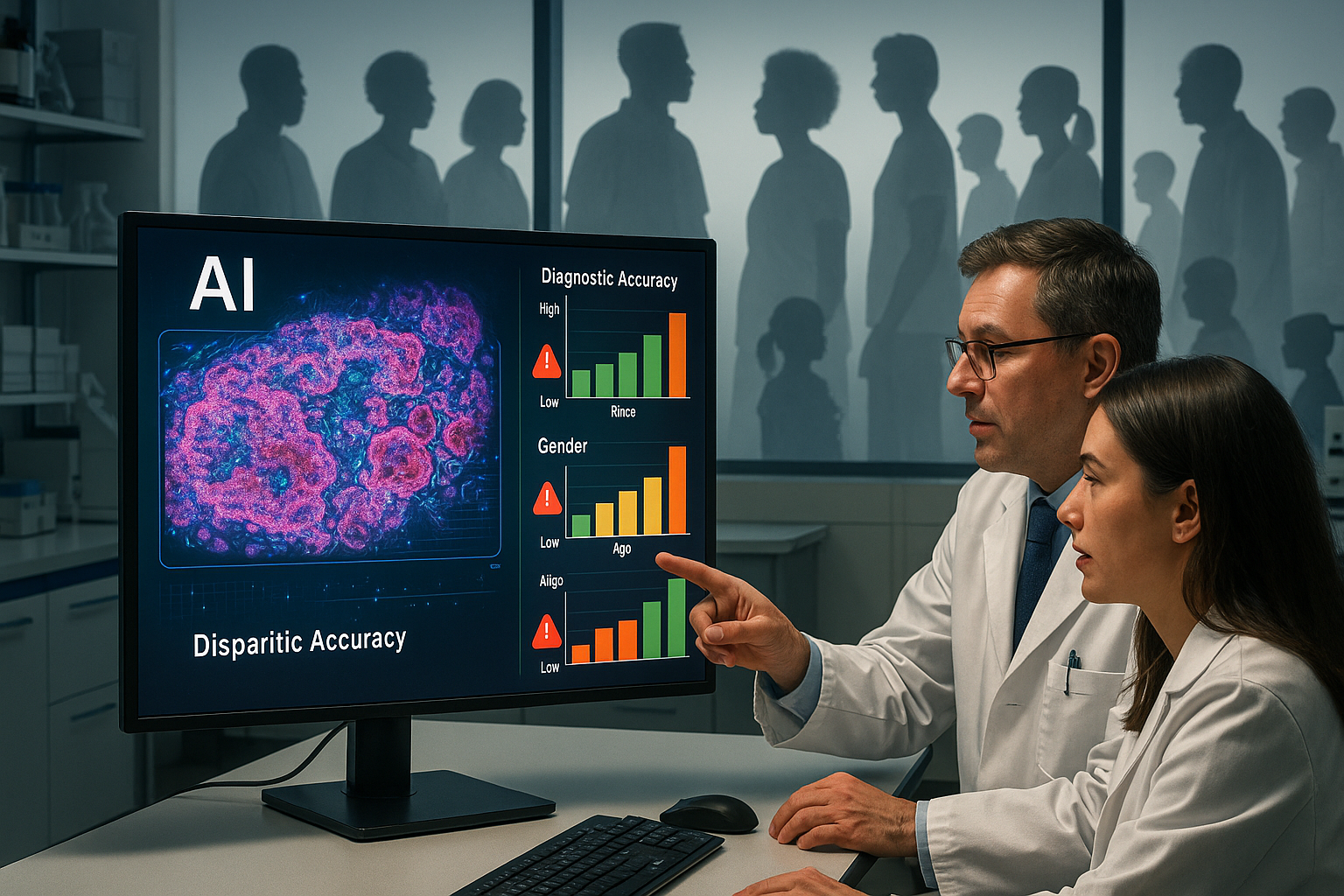

Les systèmes d’intelligence artificielle conçus pour diagnostiquer le cancer à partir de lames de tissu apprennent à déduire la démographie des patients, entraînant des performances diagnostiques inégales entre groupes raciaux, de genre et d’âge. Des chercheurs de la Harvard Medical School et leurs collaborateurs ont identifié le problème et développé une méthode qui réduit fortement ces disparités, soulignant la nécessité de contrôles systématiques des biais dans l’IA médicale.

Un rapport du Media Research Center a analysé la couverture dans les quatre grandes apps d’actualités — Apple News, Google News, MSN de Microsoft et Yahoo News — et a constaté une forte préférence pour les médias de gauche. L’étude, couvrant 106 jours d’Halloween à la Saint-Valentin, a montré que les sources de droite reçoivent une visibilité minimale. Les plateformes ont mis en avant des milliers d’histoires, avec des disparités dans la représentation des médias.

Rapporté par l'IA

De nouvelles recherches montrent que les algorithmes personnalisés sur des plateformes comme YouTube peuvent entraver l'apprentissage en limitant l'exposition aux informations, même pour ceux sans connaissances préalables. Les participants à une étude ont exploré moins de matériel, tiré des conclusions erronées et se sont sentis excessivement confiants dans leurs erreurs. Les résultats mettent en lumière les risques d'une compréhension biaisée dans les interactions numériques quotidiennes.