Bias

Alat AI kanker bisa menyimpulkan demografi pasien, memicu kekhawatiran bias

Dilaporkan oleh AI Gambar dihasilkan oleh AI Fakta terverifikasi

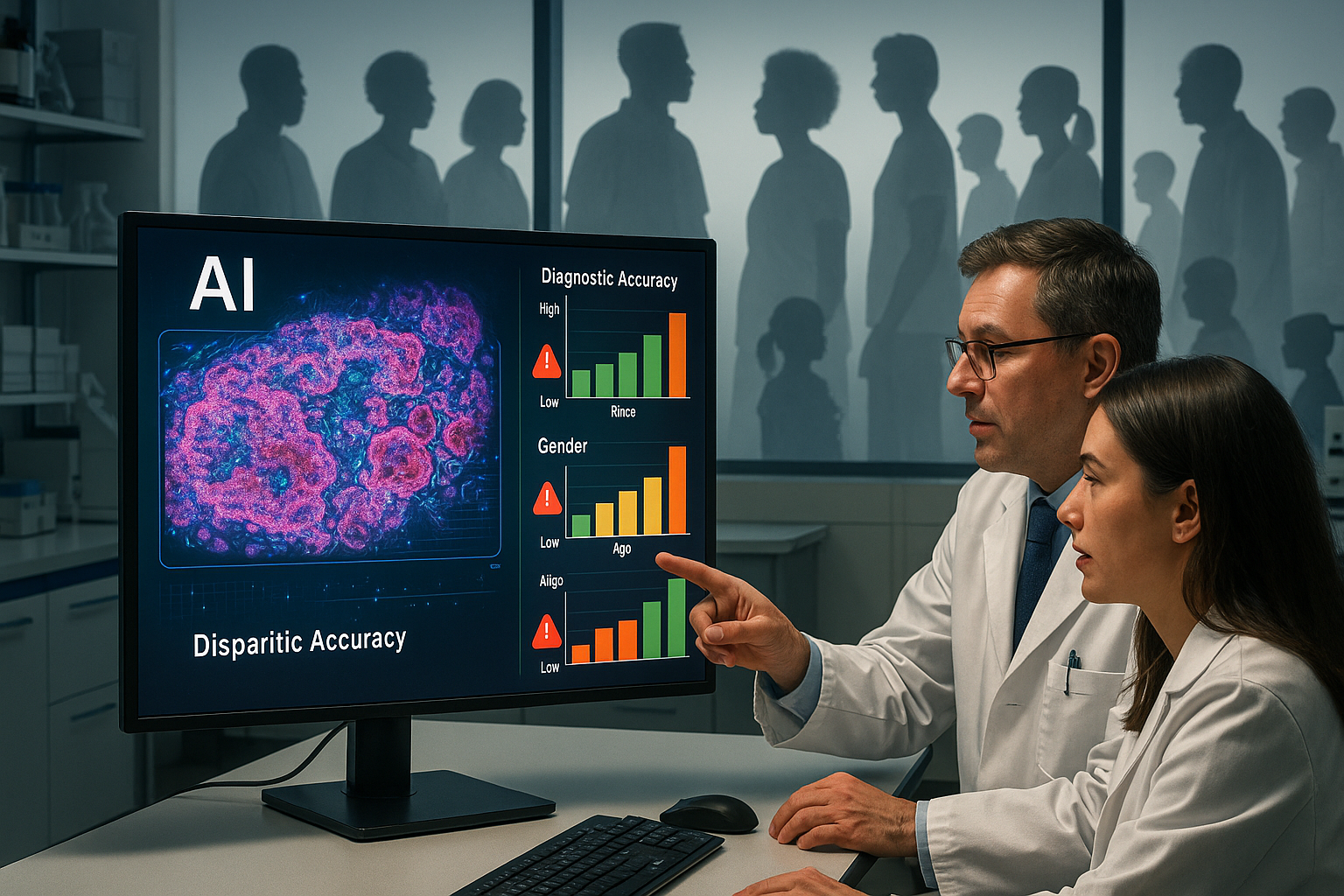

Sistem kecerdasan buatan yang dirancang untuk mendiagnosis kanker dari irisan jaringan belajar menyimpulkan demografi pasien, menyebabkan kinerja diagnostik tidak merata di berbagai kelompok ras, gender, dan usia. Peneliti di Harvard Medical School dan kolaborator mengidentifikasi masalah ini dan mengembangkan metode yang secara tajam mengurangi disparitas ini, menekankan perlunya pemeriksaan bias rutin dalam AI medis.

Laporan dari Media Research Center menganalisis liputan di empat aplikasi berita besar—Apple News, Google News, MSN milik Microsoft, dan Yahoo News—menemukan preferensi kuat terhadap outlet kiri. Studi yang mencakup 106 hari dari Halloween hingga Hari Valentine menunjukkan sumber kanan mendapat visibilitas minimal. Platform menampilkan ribuan cerita, dengan disparitas dalam representasi outlet.

Dilaporkan oleh AI

Penelitian baru menunjukkan bahwa algoritma yang dipersonalisasi di platform seperti YouTube dapat menghambat pembelajaran dengan membatasi paparan terhadap informasi, bahkan bagi mereka yang tidak memiliki pengetahuan sebelumnya. Peserta dalam sebuah studi mengeksplorasi lebih sedikit materi, menarik kesimpulan yang salah, dan merasa terlalu percaya diri dengan kesalahan mereka. Temuan ini menyoroti risiko pemahaman yang bias dalam interaksi digital sehari-hari.