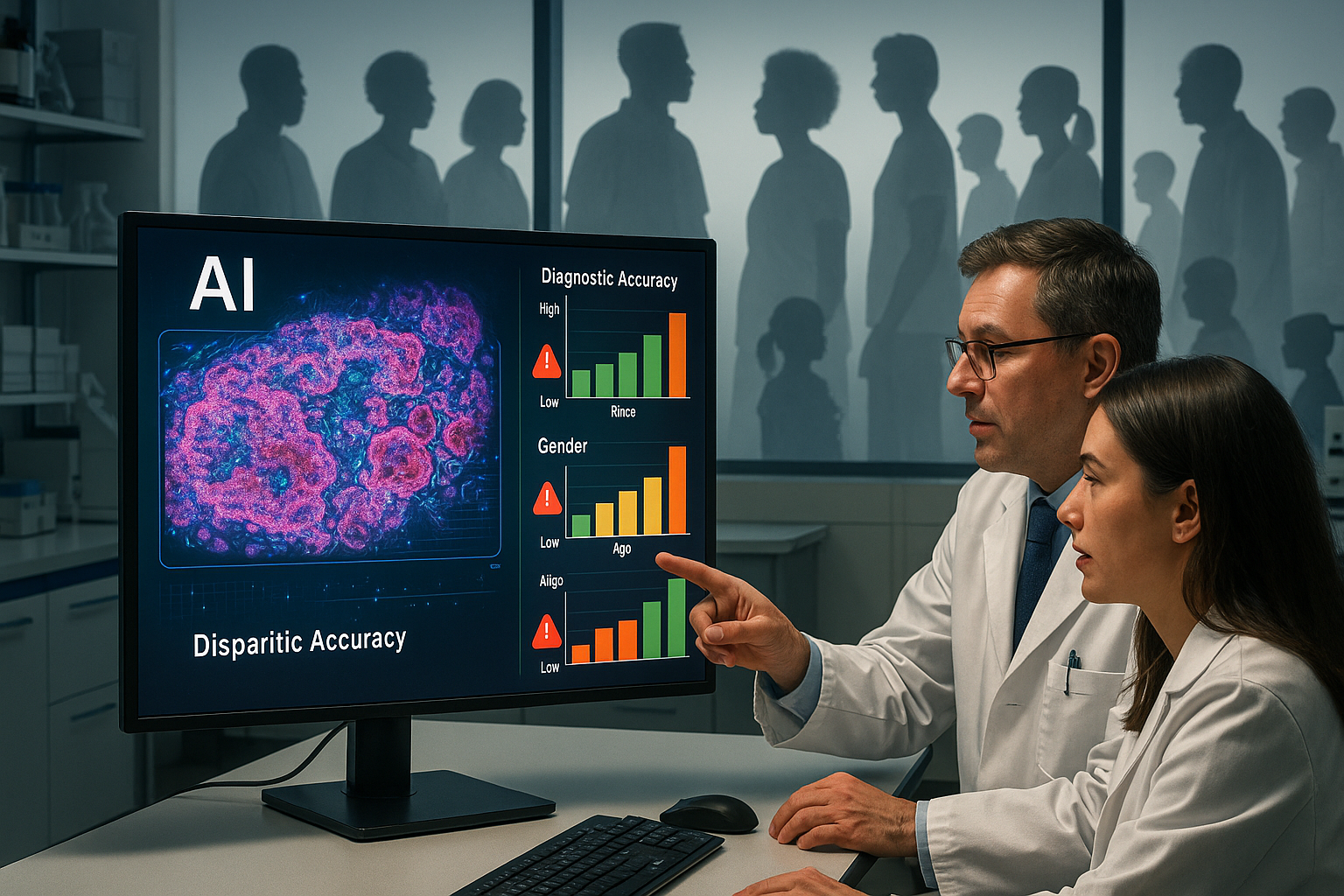

Sistem kecerdasan buatan yang dirancang untuk mendiagnosis kanker dari irisan jaringan belajar menyimpulkan demografi pasien, menyebabkan kinerja diagnostik tidak merata di berbagai kelompok ras, gender, dan usia. Peneliti di Harvard Medical School dan kolaborator mengidentifikasi masalah ini dan mengembangkan metode yang secara tajam mengurangi disparitas ini, menekankan perlunya pemeriksaan bias rutin dalam AI medis.

Patologi telah lama bergantung pada pemeriksaan irisan jaringan tipis di bawah mikroskop untuk mendiagnosis kanker, proses yang biasanya tidak mengungkap karakteristik demografis pasien bagi mata manusia. Namun, penelitian baru menunjukkan bahwa model AI yang memasuki laboratorium patologi tidak memiliki keterbatasan ini.

Sebuah studi yang dipimpin oleh Kun-Hsing Yu, profesor associate informatika biomedis di Blavatnik Institute di Harvard Medical School dan asisten profesor patologi di Brigham and Women's Hospital, menganalisis beberapa sistem patologi deep-learning standar yang dilatih pada koleksi besar slide berlabel untuk diagnosis kanker.

Menurut Harvard Medical School dan studi yang diterbitkan di Cell Reports Medicine, tim mengevaluasi empat model AI patologi yang umum digunakan pada repositori patologi multi-institusi besar yang mencakup 20 jenis kanker.

Peneliti menemukan bahwa keempat model menunjukkan kinerja tidak merata di seluruh kelompok demografis yang didefinisikan oleh ras, gender, dan usia yang dilaporkan sendiri oleh pasien. Dalam analisis pan-kanker, mereka mengidentifikasi disparitas kinerja signifikan pada sekitar 29 persen tugas diagnostik.

Pelaporan lanjutan oleh outlet termasuk News-Medical mencatat bahwa disparitas sangat terlihat pada tugas subtipe kanker paru dan payudara tertentu, dengan kinerja rendah untuk pasien Afrika Amerika dan beberapa pasien pria pada pembedaan kanker paru, dan untuk pasien muda pada beberapa pembedaan subtipe kanker payudara.

Tim penelitian melacak kesenjangan ini ke beberapa faktor. Salah satunya adalah representasi tidak merata kelompok demografis dalam data pelatihan. Yang lain melibatkan perbedaan insidensi dan biologi penyakit di berbagai populasi. Makalah Cell Reports Medicine lebih lanjut melaporkan bahwa variasi dalam prevalensi mutasi somatik di antara populasi berkontribusi pada disparitas kinerja, menunjukkan bahwa model menangkap pola molekuler halus yang terkait dengan demografi serta penyakit.

"Membaca demografi dari slide patologi dianggap sebagai 'misi mustahil' bagi ahli patologi manusia, jadi bias dalam AI patologi mengejutkan kami," kata Yu, menurut Harvard Medical School.

Untuk mengatasi masalah ini, peneliti mengembangkan FAIR-Path (Fairness-aware Artificial Intelligence Review for Pathology), kerangka mitigasi bias yang dibangun di atas konsep machine learning yang ada yang dikenal sebagai pembelajaran kontras. Pendekatan ini mendorong model untuk menekankan perbedaan antara jenis kanker sambil meremehkan perbedaan yang terkait dengan kategori demografis.

Dalam studi Cell Reports Medicine, FAIR-Path mengurangi 88,5 persen disparitas kinerja yang diukur di seluruh kelompok demografis dalam analisis pan-kanker utama dan mengurangi kesenjangan kinerja sebesar 91,1 persen dalam validasi eksternal di 15 kohort independen.

Yu dan rekan-rekannya melaporkan bahwa FAIR-Path meningkatkan keadilan tanpa memerlukan dataset yang seimbang sempurna dan dengan perubahan relatif sederhana pada pipeline pelatihan model yang ada.

Pekerjaan ini, yang dijelaskan pada 16 Desember 2025 di Cell Reports Medicine, menyoroti pentingnya pengujian sistematis sistem AI medis untuk bias demografis sebelum diterapkan dalam perawatan klinis.

Menurut liputan lanjutan dari Harvard Medical School dan SciTechDaily, tim sekarang sedang mengeksplorasi bagaimana memperluas FAIR-Path ke pengaturan dengan data terbatas dan memahami lebih baik bagaimana bias yang didorong AI berkontribusi pada disparitas hasil kesehatan yang lebih luas. Tujuan jangka panjang mereka adalah mengembangkan alat AI patologi yang mendukung ahli manusia dengan memberikan diagnosis cepat, akurat, dan adil bagi pasien dari semua latar belakang.