Imagerie Médicale

La cryo-expansion microscopique capture l'architecture 3D des lymphocytes T tueurs au niveau de la synapse immunitaire, y compris dans les tumeurs humaines

Rapporté par l'IA Image générée par IA Vérifié par des faits

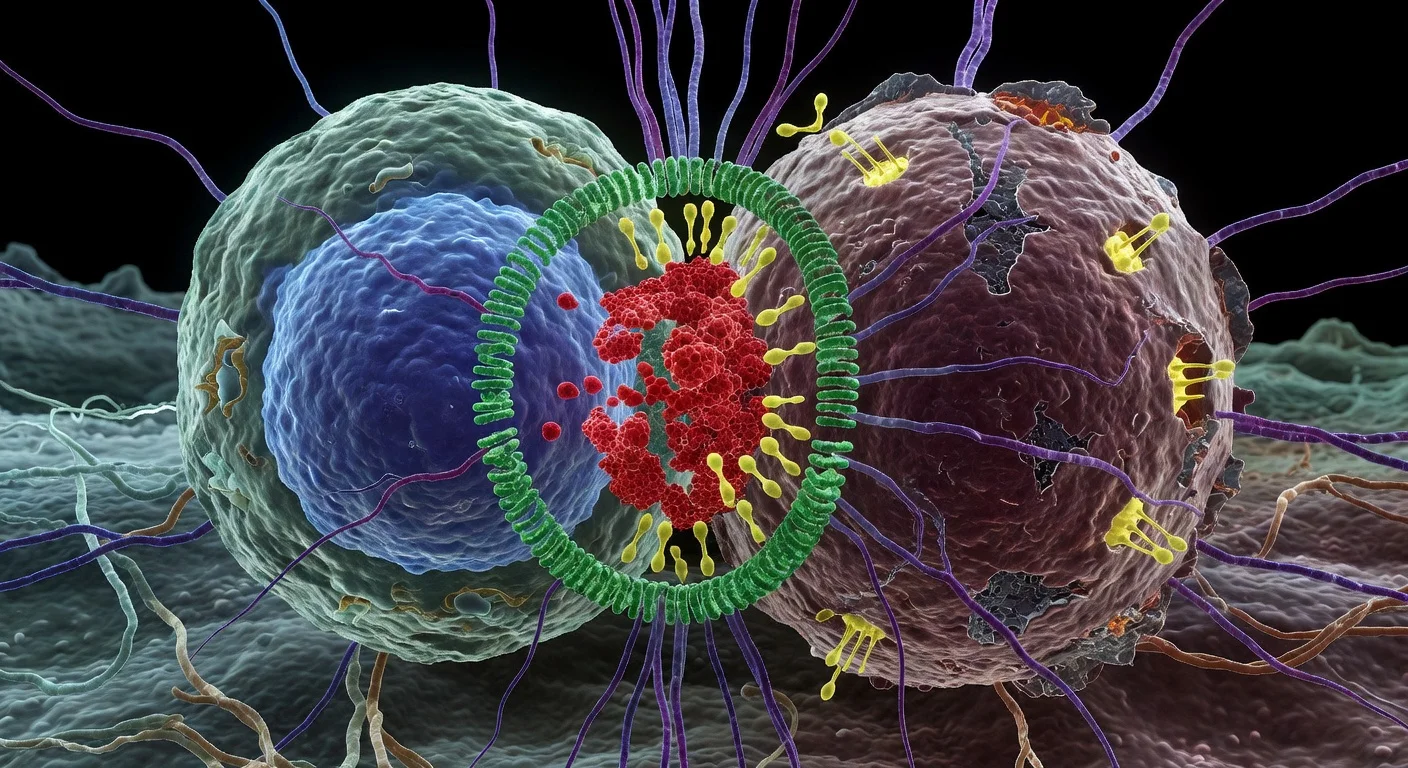

Des chercheurs de l'Université de Genève et du Centre hospitalier universitaire vaudois (CHUV) rapportent avoir visualisé, en trois dimensions et dans des conditions proches de l'état natif, la manière dont les lymphocytes T cytotoxiques organisent leur machinerie létale au niveau de la synapse immunitaire. Ces travaux, publiés dans Cell Reports, appliquent la cryo-expansion microscopique à des lymphocytes T humains et à des échantillons de tissus tumoraux, offrant des vues à l'échelle nanométrique destinées à soutenir la recherche en immunologie et en cancérologie.

Des chercheurs du MIT ont découvert que la lumière laser chaotique peut s'auto-organiser en un faisceau étroit hautement focalisé, permettant une imagerie 3D de la barrière hémato-encéphalique 25 fois plus rapide que les méthodes actuelles. Cette technique permet l'observation en temps réel de l'entrée de médicaments dans les cellules cérébrales sans recourir à des marqueurs fluorescents. Cette avancée pourrait accélérer le développement de traitements contre des maladies neurologiques comme Alzheimer et la SLA.

Rapporté par l'IA Vérifié par des faits

Une étude publiée le 24 mars 2026 dans la revue Radiology rapporte que des radiographies « deepfake » créées par intelligence artificielle peuvent être suffisamment convaincantes pour tromper les radiologues ainsi que plusieurs systèmes d'IA multimodaux. Lors des tests, le taux de précision moyen des radiologues est passé de 41 %, lorsqu'ils n'étaient pas avertis de la présence de fausses images, à 75 % après avoir été prévenus, ce qui souligne les risques potentiels pour la sécurité de l'imagerie médicale et la prise de décision clinique.

Des chercheurs de l'Université de Surrey ont développé un système d'IA qui prédit l'apparence d'une radiographie de genou d'un patient un an à l'avance, aidant à la gestion de l'arthrose. L'outil génère des prévisions visuelles et des scores de risque, présentés à MICCAI 2025. Il promet des prédictions plus rapides et transparentes pour une meilleure prise en charge des patients.

Rapporté par l'IA

Des chercheurs de l'Université du Sud de la Californie ont développé la première méthode non invasive pour capturer les pulsations rythmiques des plus petits vaisseaux sanguins du cerveau. En utilisant une IRM 7T avancée, ils ont découvert que ces pulsations s'intensifient avec l'âge et l'hypertension, perturbant potentiellement l'élimination des déchets et contribuant à la maladie d'Alzheimer. Ces résultats, publiés dans Nature Cardiovascular Research, pourraient mener à de nouveaux biomarqueurs pour les affections neurodégénératives.