Imágenes Médicas

La criomicroscopía de expansión captura la arquitectura 3D de las células T asesinas en la sinapsis inmunitaria, incluso en tumores humanos

Reportado por IA Imagen generada por IA Verificado por hechos

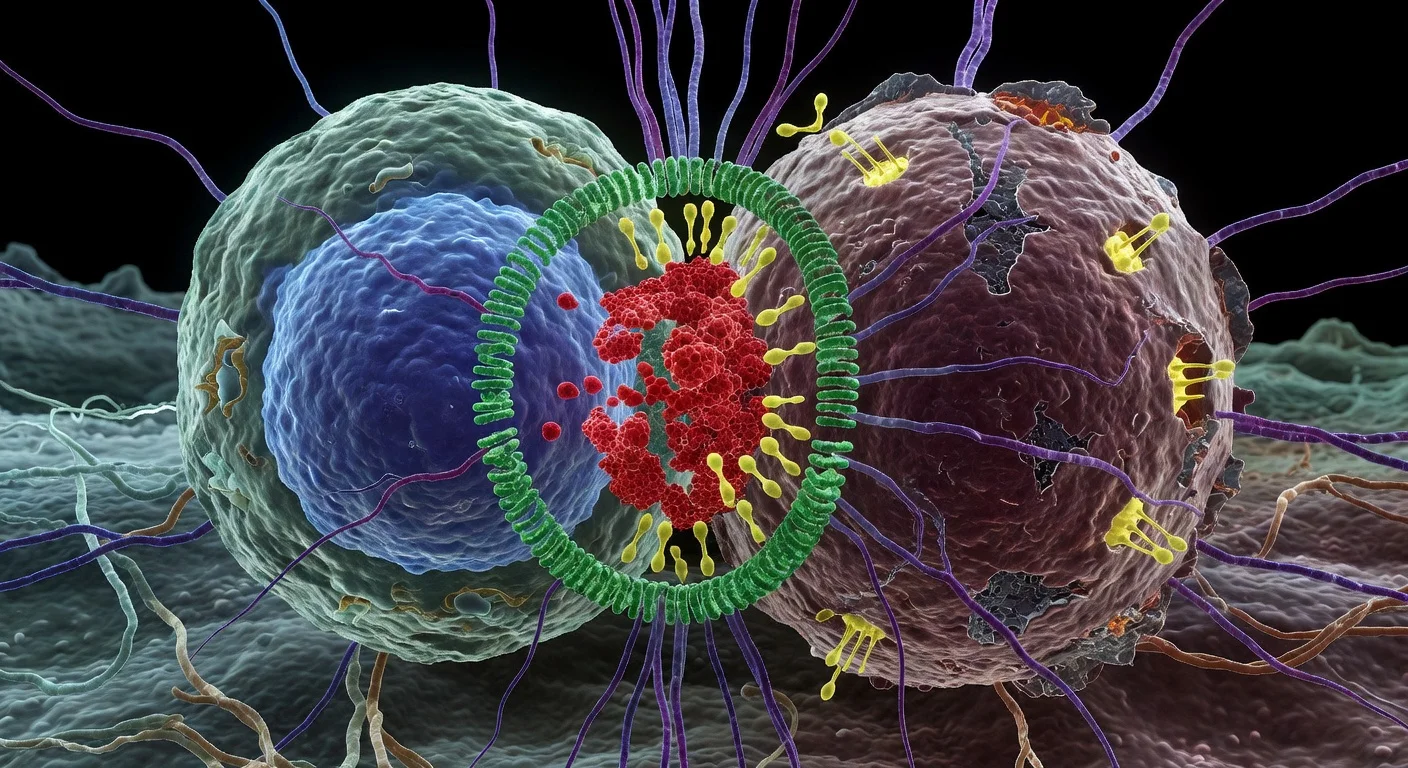

Investigadores de la Universidad de Ginebra y del Hospital Universitario de Lausana informan que han visualizado, en tres dimensiones y bajo condiciones casi nativas, cómo las células T citotóxicas organizan su maquinaria de eliminación en la sinapsis inmunitaria. El trabajo, publicado en Cell Reports, aplica la criomicroscopía de expansión a células T humanas y muestras de tejido tumoral, proporcionando vistas a nanoescala destinadas a apoyar la investigación en inmunología y cáncer.

Investigadores del MIT han descubierto que la luz láser caótica puede autoorganizarse en un haz concentrado de alta precisión, permitiendo obtener imágenes en 3D de la barrera hematoencefálica 25 veces más rápido que los métodos actuales. Esta técnica permite la observación en tiempo real de fármacos que entran en las células cerebrales sin necesidad de marcadores fluorescentes. Este avance podría acelerar el desarrollo de tratamientos para enfermedades neurológicas como el Alzheimer y la ELA.

Reportado por IA Verificado por hechos

Un estudio publicado el 24 de marzo de 2026 en *Radiology* informa que las radiografías “deepfake” generadas por IA pueden ser lo suficientemente convincentes como para engañar a radiólogos y a varios sistemas de IA multimodal. En las pruebas, la precisión media de los radiólogos aumentó del 41 %, cuando no se les advirtió de la presencia de imágenes falsas, al 75 % cuando se les informó, lo que pone de relieve los riesgos potenciales para la seguridad de las imágenes médicas y la toma de decisiones clínicas.

Investigadores de la Universidad de Surrey han desarrollado un sistema de IA que predice la apariencia de una radiografía de rodilla de un paciente un año por delante, ayudando en la gestión de la osteoartritis. La herramienta genera pronósticos visuales y puntuaciones de riesgo, presentados en MICCAI 2025. Promete predicciones más rápidas y transparentes para una mejor atención al paciente.

Reportado por IA

Investigadores de la Universidad del Sur de California han desarrollado el primer método no invasivo para capturar el pulso rítmico de los vasos sanguíneos más pequeños del cerebro. Usando una resonancia magnética avanzada de 7T, encontraron que estos pulsos se fortalecen con la edad y la hipertensión, potencialmente interrumpiendo la eliminación de desechos y contribuyendo a la enfermedad de Alzheimer. Los hallazgos, publicados en Nature Cardiovascular Research, podrían llevar a nuevos biomarcadores para condiciones neurodegenerativas.