Investigadores de la Universidad de Purdue y el Instituto de Tecnología de Georgia han propuesto una nueva arquitectura informática para modelos de IA inspirada en el cerebro humano. Este enfoque busca abordar el problema de la 'pared de memoria' intensivo en energía en los sistemas actuales. El estudio, publicado en Frontiers in Science, destaca el potencial para una IA más eficiente en dispositivos cotidianos.

El rápido crecimiento de la IA ha agravado los desafíos en el diseño de computadoras, particularmente la separación entre procesamiento y memoria en los sistemas tradicionales. Un estudio publicado el lunes en la revista Frontiers in Science describe una solución inspirada en el cerebro para este problema. Dirigido por Kaushik Roy, profesor de ingeniería informática en la Universidad de Purdue, la investigación aboga por repensar la arquitectura de la IA para hacerla más eficiente energéticamente.

Las computadoras actuales siguen la arquitectura de von Neumann, desarrollada en 1945, que mantiene separadas la memoria y el procesamiento. Este diseño crea un cuello de botella conocido como la 'pared de memoria', un término acuñado por investigadores de la Universidad de Virginia en la década de 1990. A medida que los modelos de IA, especialmente los procesadores de lenguaje, han crecido 5000 veces en tamaño en los últimos cuatro años, la disparidad entre la velocidad de la memoria y la potencia de procesamiento se ha vuelto más apremiante. IBM enfatizó recientemente este problema en un informe.

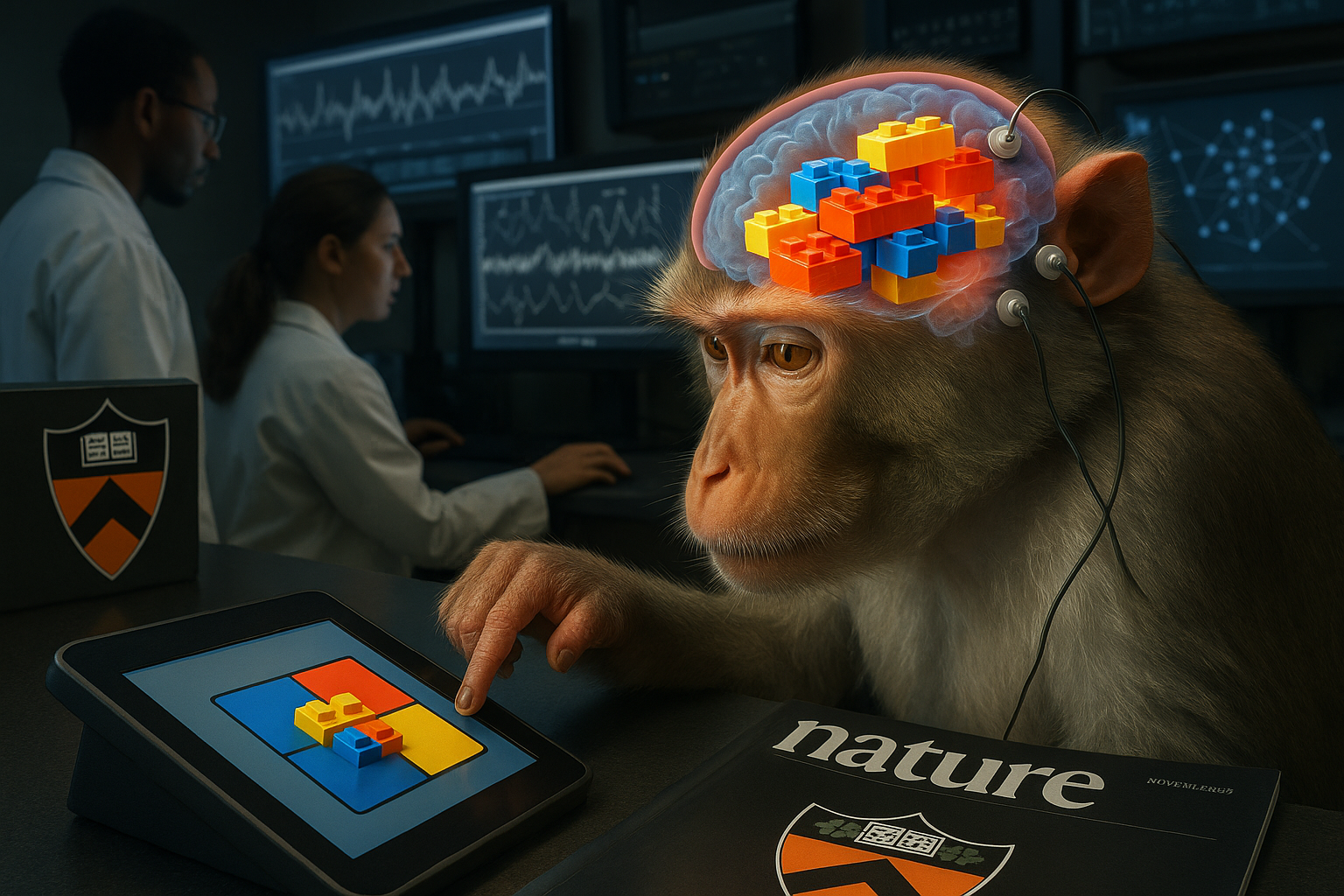

La solución propuesta se inspira en el funcionamiento del cerebro, utilizando redes neuronales de picos (SNN). Estos algoritmos, antes criticados por ser lentos e imprecisos, han mejorado significativamente en los últimos años. Los investigadores abogan por 'compute-in-memory' (CIM), que integra el cómputo directamente en el sistema de memoria. Como se indica en el resumen del artículo, «CIM ofrece una solución prometedora al problema de la pared de memoria al integrar capacidades de cómputo directamente en el sistema de memoria».

Roy señaló: «Los modelos de procesamiento de lenguaje han crecido 5000 veces en tamaño en los últimos cuatro años. Esta expansión alarmantemente rápida hace crucial que la IA sea lo más eficiente posible. Eso significa repensar fundamentalmente cómo se diseñan las computadoras».

La coautora Tanvi Sharma, investigadora de Purdue, añadió: «La IA es una de las tecnologías más transformadoras del siglo XXI. Sin embargo, para sacarla de los centros de datos y llevarla al mundo real, necesitamos reducir drásticamente su consumo energético». Explicó que esto podría habilitar la IA en dispositivos compactos como herramientas médicas, vehículos y drones, con mayor duración de batería y menos transferencia de datos.

Al minimizar el desperdicio energético, este enfoque podría hacer la IA más accesible más allá de los grandes centros de datos, apoyando aplicaciones más amplias en entornos con recursos limitados.