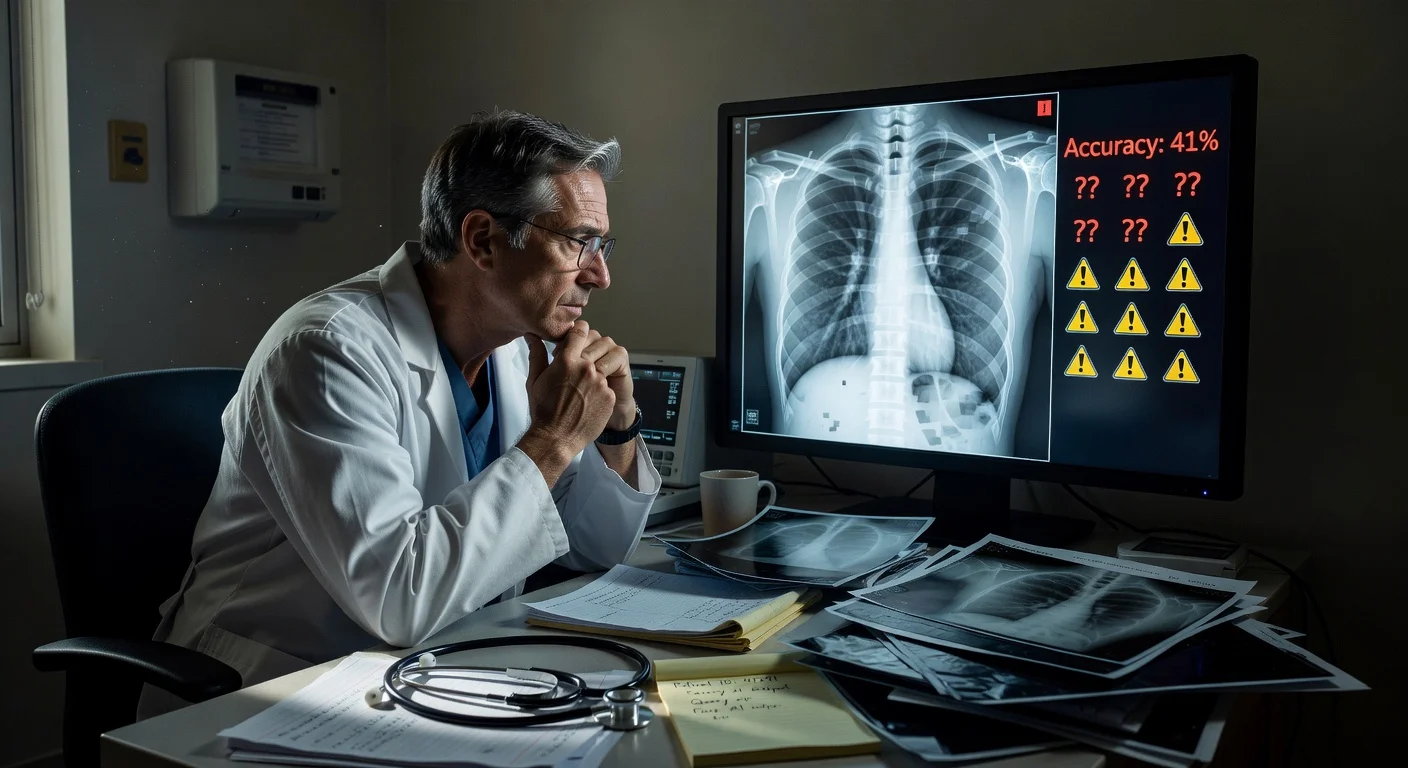

Une étude publiée le 24 mars 2026 dans la revue Radiology rapporte que des radiographies « deepfake » créées par intelligence artificielle peuvent être suffisamment convaincantes pour tromper les radiologues ainsi que plusieurs systèmes d'IA multimodaux. Lors des tests, le taux de précision moyen des radiologues est passé de 41 %, lorsqu'ils n'étaient pas avertis de la présence de fausses images, à 75 % après avoir été prévenus, ce qui souligne les risques potentiels pour la sécurité de l'imagerie médicale et la prise de décision clinique.

Des radiologues issus de 12 institutions réparties dans six pays — les États-Unis, la France, l'Allemagne, la Turquie, le Royaume-Uni et les Émirats arabes unis — ont participé aux tests d'examen d'images décrits dans une étude publiée le 24 mars 2026 dans Radiology, la revue de la Radiological Society of North America.

L'étude a inclus 17 radiologues, dont l'expérience allait de débutants à des médecins comptant jusqu'à 40 ans de pratique. Ils ont évalué 264 radiographies, réparties équitablement entre de véritables clichés et des images générées par IA.

Les participants ont examiné deux séries d'images sans chevauchement. La première série mélangeait des images réelles et des radiographies générées via ChatGPT, incluant des clichés de différentes parties du corps. La seconde série se concentrait sur des radiographies thoraciques, dont la moitié était réelle et l'autre générée avec RoentGen, un modèle de diffusion open-source développé par des chercheurs de Stanford Medicine.

Lorsque les radiologues n'étaient pas informés de la présence de fausses images, ils ont reconnu les radiographies générées par IA dans 41 % des cas. Une fois avertis de la présence d'images synthétiques, leur précision moyenne pour distinguer le vrai du faux a grimpé à 75 %.

Les performances ont varié considérablement d'un individu à l'autre. Les radiologues ont correctement identifié entre 58 % et 92 % des images générées par ChatGPT. Pour les radiographies thoraciques issues de RoentGen, la précision des radiologues oscillait entre 62 % et 78 %.

Les chercheurs ont également testé plusieurs modèles de langage multimodaux sur la même tâche. Quatre systèmes — GPT-4o et GPT-5 d'OpenAI, Gemini 2.5 Pro de Google, et Llama 4 Maverick de Meta — ont atteint des taux de précision allant de 57 % à 85 %. Même ChatGPT-4o, utilisé pour générer certaines de ces images deepfake, ne les a pas toutes détectées, bien qu'il ait surpassé les autres modèles.

L'étude n'a révélé aucun lien entre les années d'expérience en radiologie et la capacité à identifier de fausses radiographies, mais a noté que les radiologues spécialisés en musculosquelettique ont obtenu de meilleurs résultats que les autres sous-spécialistes.

L'auteur principal, le Dr Mickael Tordjman, chercheur post-doctoral à la Icahn School of Medicine at Mount Sinai à New York, a déclaré que ces résultats pointent vers des vulnérabilités tant juridiques qu'en cybersécurité. « Cela crée une vulnérabilité à enjeux élevés pour les litiges frauduleux si, par exemple, une fracture fabriquée était indiscernable d'une réelle », a-t-il affirmé, ajoutant qu'il existe « un risque significatif de cybersécurité si des pirates accédaient au réseau d'un hôpital pour injecter des images synthétiques afin de manipuler les diagnostics des patients ou provoquer un chaos clinique généralisé en sapant la fiabilité fondamentale du dossier médical numérique ».

Le Dr Tordjman a également décrit des motifs visuels pouvant apparaître sur les images synthétiques, expliquant que les images médicales deepfake peuvent sembler « trop parfaites », avec des os trop lisses, des colonnes vertébrales artificiellement droites, des poumons excessivement symétriques, des motifs de vaisseaux sanguins trop uniformes et des fractures à l'aspect inhabituellement net.

Pour réduire les risques de falsification et de mauvaise attribution, les chercheurs ont recommandé des mesures de protection, notamment l'intégration de filigranes invisibles directement dans les images et de signatures cryptographiques liées au manipulateur radio au moment de la capture. Ils ont également précisé avoir publié un ensemble de données deepfake avec des quiz interactifs destinés à la formation et à la sensibilisation.

« Nous ne voyons potentiellement que la partie émergée de l'iceberg », a conclu le Dr Tordjman, soutenant que les images 3D générées par IA, comme les scanners ou les IRM, pourraient être la prochaine étape et que des outils de détection ainsi que des ressources pédagogiques devraient être développés dès maintenant.