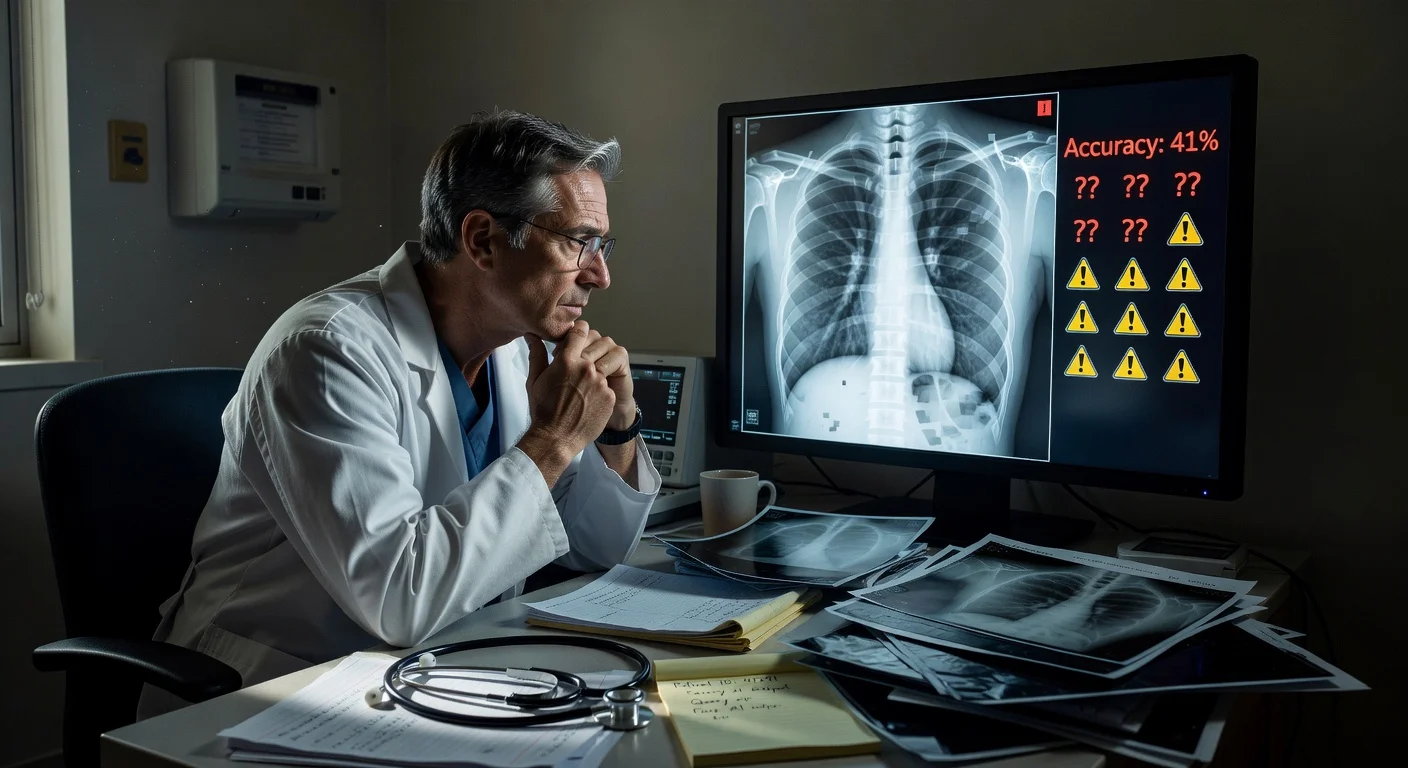

2026年3月24日付の学術誌『Radiology』に掲載された研究によると、AIが生成した「ディープフェイク」X線画像は、放射線科医や複数のマルチモーダルAIシステムを誤認させるほど精巧である可能性があることが報告された。テストにおいて、偽画像が含まれていると知らされていない状態では放射線科医の平均正解率は41%だったが、偽画像が含まれているという警告を受けた後には75%まで上昇した。この結果は、医療用画像のセキュリティおよび臨床判断における潜在的なリスクを浮き彫りにしている。

米国、フランス、ドイツ、トルコ、英国、アラブ首長国連邦の6カ国、12機関の放射線科医が、北米放射線学会(RSNA)の学術誌『Radiology』に2026年3月24日付で掲載された研究の画像レビューテストに参加した。

本研究には、初学者から経験40年の医師まで、さまざまな経歴を持つ17名の放射線科医が参加した。彼らは、実物のスキャン画像とAI生成画像を均等に混合した計264枚のX線画像を評価した。

参加者は重複のない2つの画像セットをレビューした。1つ目のセットは、ChatGPTを使用して作成された全身の様々な部位のX線画像と実物の画像を混ぜたもの。2つ目のセットは胸部X線画像に焦点を当てたもので、半分が実物、残りの半分はスタンフォード大学医学部の研究者が開発したオープンソースの拡散モデル「RoentGen」を使用して生成されたものとした。

偽画像が含まれていることを知らされていない状態では、放射線科医がAI生成X線画像を正しく認識できたのは41%であった。合成画像が含まれていると知らされた後、実物と偽物を見分ける平均正解率は75%まで上昇した。

正解率は個々人で大きく異なった。ChatGPTが生成した画像については、放射線科医の正解率は58%から92%の間だった。RoentGenで生成された胸部X線画像については、62%から78%の範囲となった。

研究チームはまた、同じタスクでいくつかのマルチモーダル大規模言語モデル(LLM)をテストした。OpenAIの「GPT-4o」と「GPT-5」、Googleの「Gemini 2.5 Pro」、Metaの「Llama 4 Maverick」の4システムは、57%から85%の正解率を記録した。一部のディープフェイク画像の生成にも使用されたChatGPT-4oでさえも、すべての画像を検出できたわけではなかったが、他のモデルよりは高い性能を示した。

研究では、放射線科医としての経験年数と偽X線画像の判別能力との間に相関は見られなかったが、筋骨格系を専門とする放射線科医は他のサブスペシャリストよりも有意に高い成績を収めたことが報告されている。

筆頭著者でニューヨークのマウントサイナイ医科大学(Icahn School of Medicine at Mount Sinai)の博士研究員であるMickael Tordjman医師は、今回の結果は法的およびサイバーセキュリティ上の脆弱性を示唆していると述べている。「例えば、偽造された骨折が本物と見分けがつかなくなれば、不正な訴訟につながるという非常にリスクの高い脆弱性が生じます」と彼は指摘し、さらに「ハッカーが病院のネットワークに侵入し、合成画像を挿入して患者の診断を操作したり、電子医療記録の基本的な信頼性を損なうことで広範囲に臨床的な混乱を引き起こしたりするという重大なサイバーセキュリティリスクが存在します」と付け加えた。

Tordjman医師はまた、合成画像に見られる視覚的なパターンとして、ディープフェイク医療画像は「完璧すぎる」ことがあり、骨が過度に滑らかであったり、背骨が不自然に真っ直ぐであったり、肺が過度に左右対称であったり、血管のパターンが過度に均一であったり、骨折部が不自然にきれいに見えたりすることを挙げた。

改ざんや誤帰属のリスクを低減するため、研究チームは画像に直接埋め込まれた不可視の電子透かしや、画像撮影時の診療放射線技師とリンクされた暗号署名などの保護手段を推奨している。また、トレーニングと意識向上のための対話型クイズを含む、精選されたディープフェイクデータセットを公開したとも述べている。

「私たちが目にしているのは氷山の一角に過ぎない可能性があります」とTordjman医師は述べ、CTやMRIなどのAI生成3D画像が次の段階になる可能性があり、検出ツールや教育リソースを早期に開発すべきだと主張した。