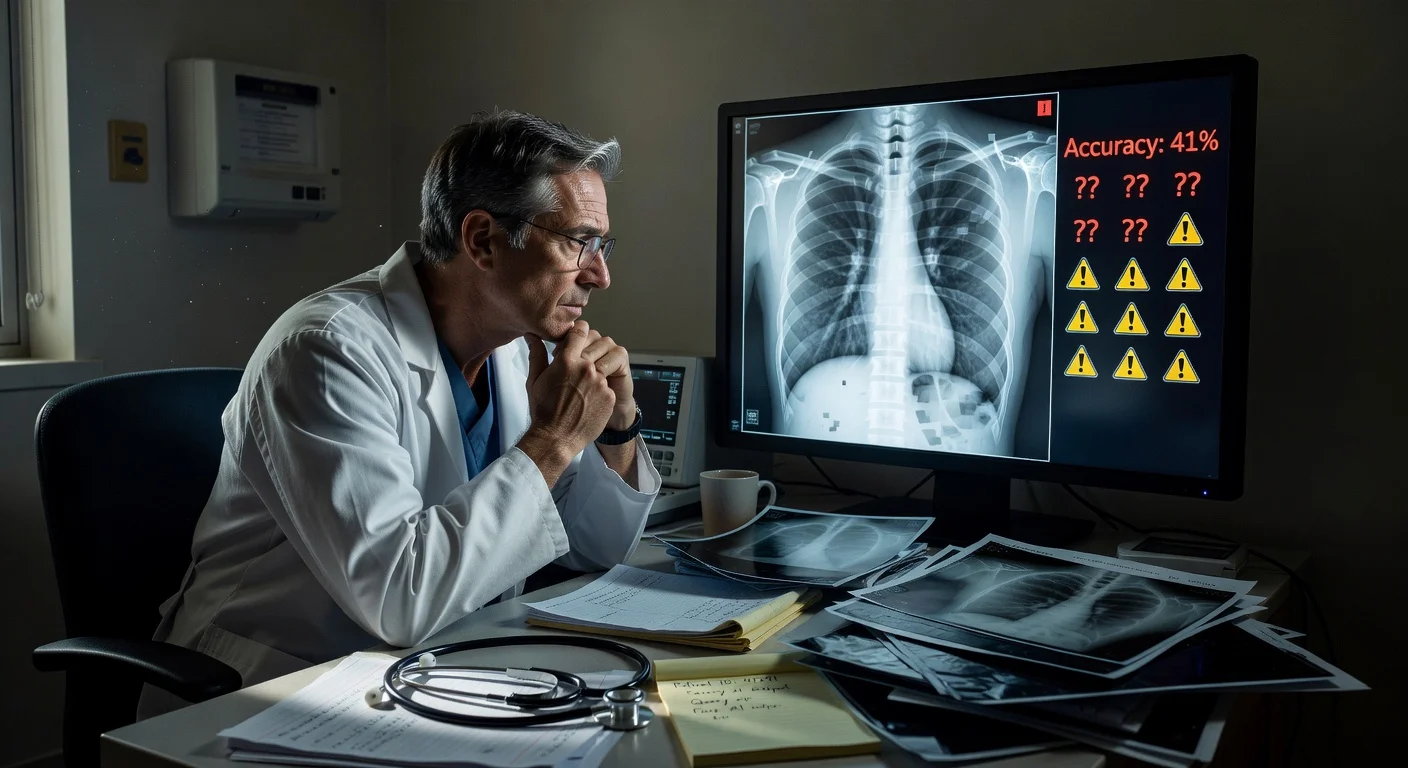

أفادت دراسة نُشرت في 24 مارس 2026 في مجلة "Radiology" بأن صور الأشعة السينية المزيفة (ديب فيك) التي تم إنشاؤها بواسطة الذكاء الاصطناعي يمكن أن تكون مقنعة لدرجة تضليل أطباء الأشعة والعديد من أنظمة الذكاء الاصطناعي متعددة الوسائط. وفي الاختبارات، ارتفع متوسط دقة أطباء الأشعة من 41% عندما لم يتم إبلاغهم بوجود صور مزيفة إلى 75% عند تحذيرهم، مما يسلط الضوء على المخاطر المحتملة على أمن التصوير الطبي واتخاذ القرارات السريرية.

شارك أطباء أشعة من 12 مؤسسة في ست دول—الولايات المتحدة، فرنسا، ألمانيا، تركيا، المملكة المتحدة، والإمارات العربية المتحدة—في اختبارات مراجعة الصور الموصوفة في دراسة نُشرت في 24 مارس 2026 في مجلة "Radiology"، وهي مجلة جمعية الأشعة في أمريكا الشمالية.

شملت الدراسة 17 طبيب أشعة تتراوح خبراتهم من مبتدئين إلى أطباء لديهم خبرة تصل إلى 40 عاماً في الممارسة العملية. وقاموا بتقييم 264 صورة أشعة سينية مقسمة بالتساوي بين صور حقيقية وصور تم إنشاؤها بواسطة الذكاء الاصطناعي.

راجع المشاركون مجموعتين من الصور دون تداخل بينهما. مزجت المجموعة الأولى صوراً حقيقية مع صور أشعة سينية تم إنشاؤها باستخدام ChatGPT وشملت أجزاء مختلفة من الجسم. وركزت المجموعة الثانية على صور أشعة الصدر، حيث كان نصفها حقيقياً ونصفها الآخر تم إنشاؤه باستخدام RoentGen، وهو نموذج انتشار مفتوح المصدر طوره باحثون في جامعة ستانفورد للطب.

عندما لم يتم إخبار أطباء الأشعة بوجود صور مزيفة، تمكنوا من التعرف على صور الأشعة السينية التي أنشأها الذكاء الاصطناعي بنسبة 41% من الحالات. وبعد إبلاغهم بوجود صور اصطناعية، ارتفع متوسط دقتها في التمييز بين الصور الحقيقية والمزيفة إلى 75%.

تباين الأداء بشكل كبير بين الأفراد. حدد أطباء الأشعة بشكل صحيح ما بين 58% و92% من الصور التي أنشأها ChatGPT. أما بالنسبة لصور أشعة الصدر التي أنشأها RoentGen، فتراوحت دقة أطباء الأشعة بين 62% و78%.

كما اختبر الباحثون العديد من النماذج اللغوية الكبيرة متعددة الوسائط في المهمة نفسها. حققت أربعة أنظمة—وهي GPT-4o وGPT-5 من شركة OpenAI، وGemini 2.5 Pro من جوجل، وLlama 4 Maverick من شركة Meta—معدلات دقة تراوحت بين 57% و85%. حتى ChatGPT-4o، الذي استُخدم لإنشاء بعض الصور المزيفة، لم يكتشفها جميعاً، على الرغم من أدائه الأفضل مقارنة بالنماذج الأخرى.

لم تجد الدراسة أي رابط بين سنوات الخبرة في مجال الأشعة والقدرة على تحديد صور الأشعة السينية المزيفة، لكنها ذكرت أن أطباء الأشعة العضلية الهيكلية كان أداؤهم أفضل بكثير من غيرهم من المتخصصين الفرعيين.

قال المؤلف الرئيسي الدكتور ميكائيل تورجمان، وهو زميل ما بعد الدكتوراه في كلية إيكان للطب في جبل سيناء في نيويورك، إن النتائج تشير إلى ثغرات قانونية وأمنية سيبرانية. وأضاف: "هذا يخلق ثغرة عالية المخاطر للتقاضي الاحتيالي، على سبيل المثال، إذا كان من الممكن عدم التمييز بين كسر مصطنع وآخر حقيقي". كما أشار إلى وجود "خطر أمني سيبراني كبير إذا تمكن المخترقون من الوصول إلى شبكة المستشفى وحقن صور اصطناعية للتلاعب بتشخيصات المرضى أو التسبب في فوضى سريرية واسعة النطاق من خلال تقويض الموثوقية الأساسية للسجل الطبي الرقمي".

كما وصف تورجمان الأنماط البصرية التي قد تظهر في الصور الاصطناعية، قائلاً إن الصور الطبية المزيفة يمكن أن تبدو "مثالية أكثر من اللازم"، مع عظام ناعمة للغاية، وأعمدة فقارية مستقيمة بشكل غير طبيعي، ورئتين متماثلتين جداً، وأنماط أوعية دموية موحدة بشكل مفرط، وكسور تبدو نظيفة بشكل غير معتاد.

ولتقليل مخاطر التلاعب ونسب الصور لغير مصدرها، أوصى الباحثون بإجراءات وقائية تشمل علامات مائية غير مرئية مضمنة مباشرة في الصور وتوقيعات مشفرة مرتبطة بفني الأشعة في وقت التقاط الصورة. كما ذكروا أنهم نشروا مجموعة بيانات مزيفة منسقة مع اختبارات تفاعلية تهدف إلى التدريب والتوعية.

قال تورجمان: "من المحتمل أننا لا نرى سوى قمة جبل الجليد"، مجادلاً بأن صور الذكاء الاصطناعي ثلاثية الأبعاد مثل الأشعة المقطعية والرنين المغناطيسي قد تكون الخطوة التالية، وأنه يجب تطوير أدوات الكشف والموارد التعليمية في وقت مبكر.