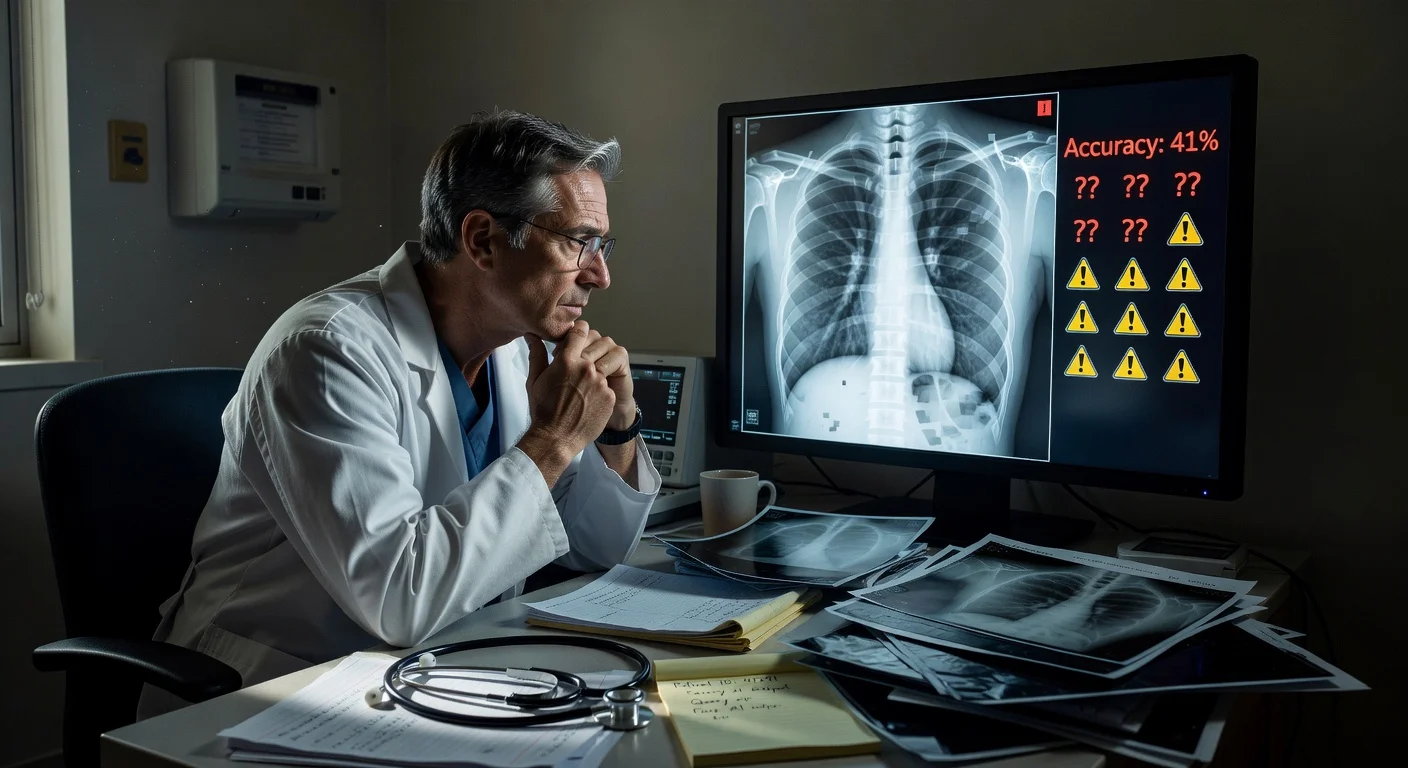

Um estudo publicado em 24 de março de 2026 na revista Radiology relata que radiografias “deepfake” geradas por IA podem ser convincentes o suficiente para enganar radiologistas e diversos sistemas de IA multimodais. Nos testes, a precisão média dos radiologistas subiu de 41%, quando não foram informados sobre a presença de imagens falsas, para 75% quando foram alertados, o que destaca riscos potenciais para a segurança de imagens médicas e a tomada de decisão clínica.

Radiologistas de 12 instituições em seis países — Estados Unidos, França, Alemanha, Turquia, Reino Unido e Emirados Árabes Unidos — participaram de testes de revisão de imagens descritos em um estudo publicado em 24 de março de 2026 na Radiology, a revista da Radiological Society of North America.

O estudo incluiu 17 radiologistas com experiência variando de iniciantes a médicos com até 40 anos de prática. Eles avaliaram 264 radiografias divididas igualmente entre exames reais e imagens geradas por IA.

Os participantes revisaram dois conjuntos de imagens sem sobreposição. Um conjunto misturou imagens reais com radiografias geradas por IA usando o ChatGPT e incluiu raios-X de diferentes partes do corpo. O segundo conjunto focou em radiografias de tórax, com metade real e metade gerada usando o RoentGen, um modelo de difusão de código aberto desenvolvido por pesquisadores da Stanford Medicine.

Quando os radiologistas não foram avisados de que imagens falsas estavam incluídas, eles reconheceram as radiografias geradas por IA em 41% das vezes. Após serem informados de que havia imagens sintéticas presentes, a precisão média deles em distinguir o real do falso subiu para 75%.

O desempenho variou bastante entre os indivíduos. Os radiologistas identificaram corretamente entre 58% e 92% das imagens geradas pelo ChatGPT. Para as radiografias de tórax geradas pelo RoentGen, a precisão dos radiologistas variou de 62% a 78%.

Os pesquisadores também testaram vários modelos de linguagem grandes multimodais na mesma tarefa. Quatro sistemas — GPT-4o e GPT-5 da OpenAI, Gemini 2.5 Pro do Google e Llama 4 Maverick da Meta — alcançaram taxas de precisão variando de 57% a 85%. Mesmo o ChatGPT-4o, que foi usado para gerar algumas das imagens deepfake, não detectou todas elas, embora tenha tido um desempenho melhor que os outros modelos.

O estudo não encontrou ligação entre os anos de experiência em radiologia e a capacidade de identificar radiografias falsas, mas relatou que radiologistas musculoesqueléticos tiveram um desempenho significativamente melhor do que outros subespecialistas.

O autor principal, Mickael Tordjman, M.D., pós-doutorando na Icahn School of Medicine at Mount Sinai em Nova York, disse que os resultados apontam para vulnerabilidades tanto jurídicas quanto de cibersegurança. “Isso cria uma vulnerabilidade de alto risco para litígios fraudulentos se, por exemplo, uma fratura fabricada for indistinguível de uma real”, disse ele, acrescentando que há “um risco significativo de cibersegurança caso hackers obtenham acesso à rede de um hospital e injetem imagens sintéticas para manipular diagnósticos de pacientes ou causar caos clínico generalizado ao minar a confiabilidade fundamental do prontuário médico digital”.

Tordjman também descreveu padrões visuais que podem aparecer em imagens sintéticas, dizendo que imagens médicas deepfake podem parecer “perfeitas demais”, com ossos excessivamente lisos, colunas vertebralmente retas demais, pulmões excessivamente simétricos, padrões de vasos sanguíneos excessivamente uniformes e fraturas com aparência estranhamente limpa.

Para reduzir o risco de adulteração e atribuição incorreta, os pesquisadores recomendaram salvaguardas, incluindo marcas d'água invisíveis incorporadas diretamente nas imagens e assinaturas criptográficas vinculadas ao tecnólogo de radiologia no momento da captura da imagem. Eles também disseram que lançaram um conjunto de dados deepfake curado com testes interativos destinados ao treinamento e conscientização.

“Estamos vendo potencialmente apenas a ponta do iceberg”, disse Tordjman, argumentando que imagens 3D geradas por IA, como tomografias computadorizadas e ressonâncias magnéticas, podem ser o próximo passo e que ferramentas de detecção e recursos educacionais devem ser desenvolvidos precocemente.