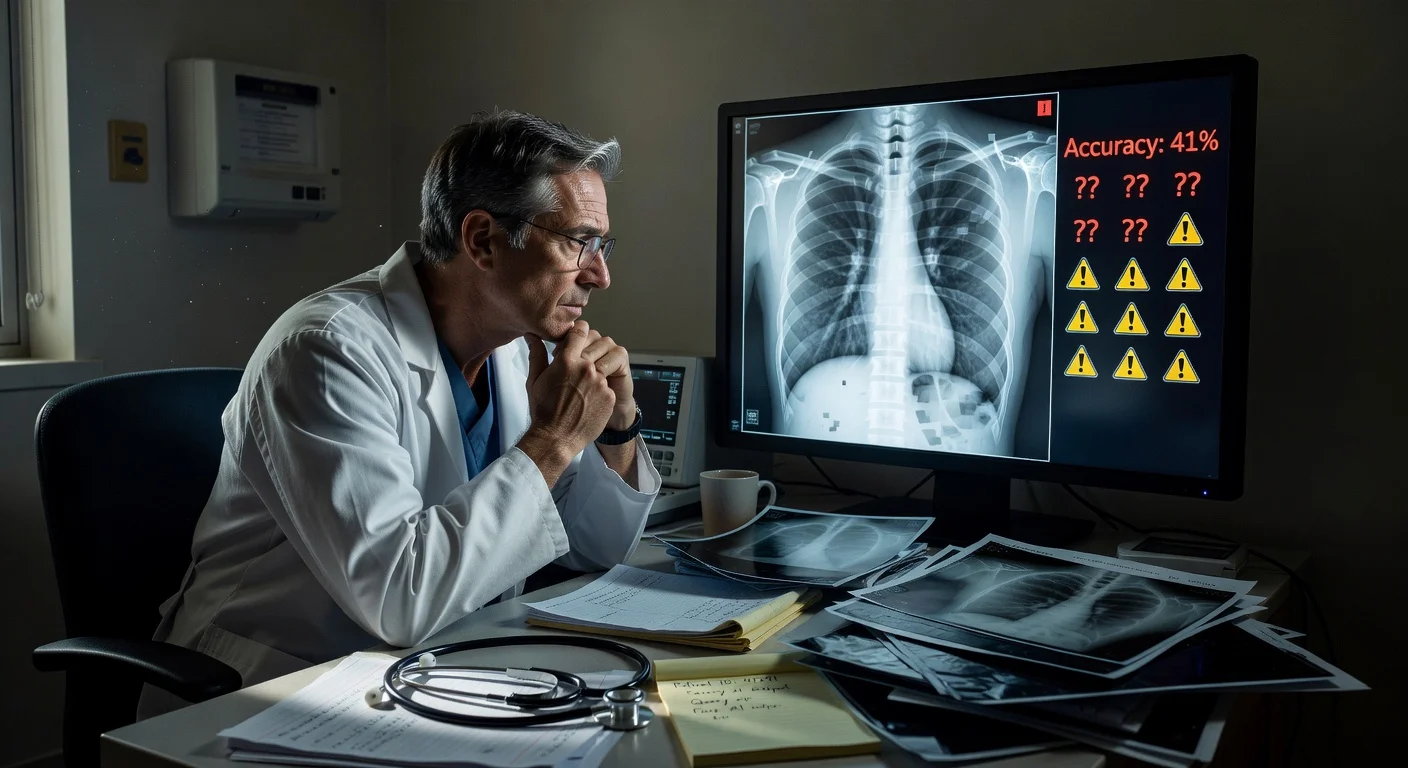

Un estudio publicado el 24 de marzo de 2026 en *Radiology* informa que las radiografías “deepfake” generadas por IA pueden ser lo suficientemente convincentes como para engañar a radiólogos y a varios sistemas de IA multimodal. En las pruebas, la precisión media de los radiólogos aumentó del 41 %, cuando no se les advirtió de la presencia de imágenes falsas, al 75 % cuando se les informó, lo que pone de relieve los riesgos potenciales para la seguridad de las imágenes médicas y la toma de decisiones clínicas.

Radiólogos de 12 instituciones en seis países (Estados Unidos, Francia, Alemania, Turquía, el Reino Unido y los Emiratos Árabes Unidos) participaron en las pruebas de revisión de imágenes descritas en un estudio publicado el 24 de marzo de 2026 en Radiology, la revista de la Radiological Society of North America.

El estudio incluyó a 17 radiólogos con una experiencia que iba desde principiantes hasta médicos con hasta 40 años de ejercicio. Evaluaron 264 imágenes de rayos X divididas equitativamente entre escaneos reales e imágenes generadas por IA.

Los participantes revisaron dos conjuntos de imágenes sin solapamiento. Un conjunto mezclaba imágenes reales con radiografías generadas por IA mediante ChatGPT e incluía radiografías de diferentes partes del cuerpo. El segundo conjunto se centró en radiografías de tórax, con la mitad reales y la otra mitad generadas mediante RoentGen, un modelo de difusión de código abierto desarrollado por investigadores de Stanford Medicine.

Cuando no se les informó a los radiólogos que se habían incluido imágenes falsas, reconocieron las radiografías generadas por IA el 41 % de las veces. Después de ser informados de la presencia de imágenes sintéticas, su precisión media para distinguir entre lo real y lo falso aumentó al 75 %.

El rendimiento varió mucho entre los individuos. Los radiólogos identificaron correctamente entre el 58 % y el 92 % de las imágenes generadas por ChatGPT. Para las radiografías de tórax generadas por RoentGen, la precisión de los radiólogos osciló entre el 62 % y el 78 %.

Los investigadores también probaron varios modelos de lenguaje extenso multimodales en la misma tarea. Cuatro sistemas (GPT-4o y GPT-5 de OpenAI, Gemini 2.5 Pro de Google y Llama 4 Maverick de Meta) alcanzaron tasas de precisión que oscilaron entre el 57 % y el 85 %. Incluso ChatGPT-4o, que se utilizó para generar algunas de las imágenes deepfake, no detectó todas, aunque su rendimiento fue mejor que el de los otros modelos.

El estudio no encontró relación entre los años de experiencia en radiología y la capacidad para identificar radiografías falsas, pero informó que los radiólogos musculoesqueléticos tuvieron un desempeño significativamente mejor que otros subespecialistas.

El autor principal, el Dr. Mickael Tordjman, becario posdoctoral en la Escuela de Medicina Icahn de Mount Sinai en Nueva York, dijo que los resultados apuntan a vulnerabilidades legales y de ciberseguridad. “Esto crea una vulnerabilidad de alto riesgo para litigios fraudulentos si, por ejemplo, una fractura fabricada fuera indistinguible de una real”, señaló, añadiendo que existe “un riesgo significativo de ciberseguridad si los hackers obtuvieran acceso a la red de un hospital e introdujeran imágenes sintéticas para manipular los diagnósticos de los pacientes o causar un caos clínico generalizado al socavar la fiabilidad fundamental de la historia clínica digital”.

Tordjman también describió patrones visuales que pueden aparecer en imágenes sintéticas, comentando que las imágenes médicas deepfake pueden parecer “demasiado perfectas”, con huesos excesivamente lisos, columnas vertebrales antinaturalmente rectas, pulmones excesivamente simétricos, patrones de vasos sanguíneos demasiado uniformes y fracturas de apariencia inusualmente limpia.

Para reducir el riesgo de manipulación y atribución errónea, los investigadores recomendaron salvaguardas que incluyen marcas de agua invisibles integradas directamente en las imágenes y firmas criptográficas vinculadas al técnico en imagenología en el momento de la captura de la imagen. También indicaron que han publicado un conjunto de datos deepfake seleccionado con cuestionarios interactivos destinados a la formación y la concienciación.

“Potencialmente solo estamos viendo la punta del iceberg”, dijo Tordjman, argumentando que las imágenes 3D generadas por IA, como las tomografías computarizadas (CT) y las resonancias magnéticas (MRI), podrían ser el siguiente paso y que se deberían desarrollar herramientas de detección y recursos educativos desde el principio.