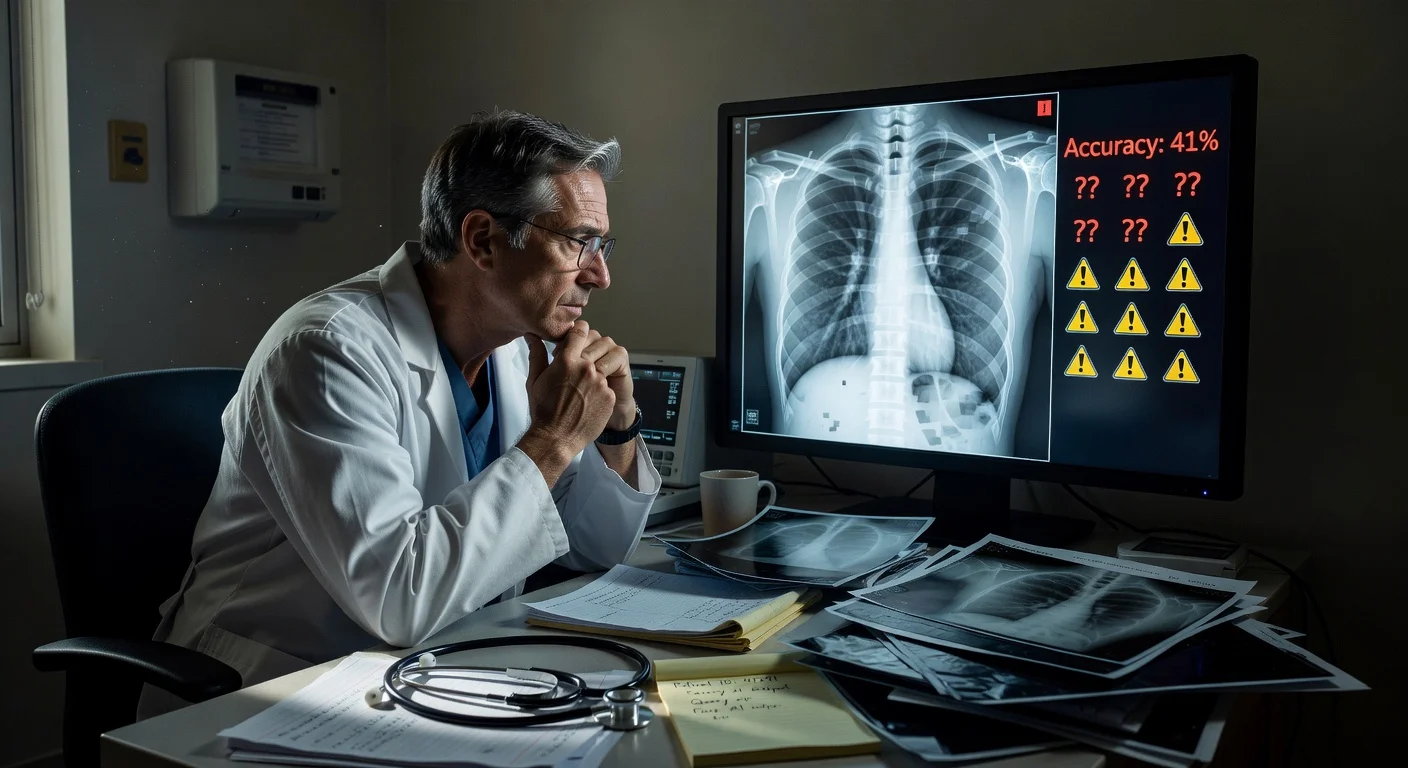

En studie publicerad den 24 mars 2026 i Radiology rapporterar att AI-genererade ”deepfake”-röntgenbilder kan vara tillräckligt övertygande för att vilseleda både radiologer och flera multimodala AI-system. Vid testning ökade radiologernas genomsnittliga träffsäkerhet från 41 % när de inte informerades om att förfalskningar ingick, till 75 % när de förvarnades, vilket belyser potentiella risker för säkerheten inom medicinsk bildbehandling och kliniskt beslutsfattande.

Radiologer från 12 institutioner i sex länder – USA, Frankrike, Tyskland, Turkiet, Storbritannien och Förenade Arabemiraten – deltog i bildgranskningstester som beskrivs i en studie publicerad den 24 mars 2026 i Radiology, tidskriften för Radiological Society of North America.

Studien inkluderade 17 radiologer med erfarenhet från nybörjare till läkare med upp till 40 års yrkesverksamhet. De utvärderade 264 röntgenbilder uppdelade jämnt mellan verkliga skanningar och AI-genererade bilder.

Deltagarna granskade två bilduppsättningar utan överlappning. En uppsättning blandade verkliga bilder med AI-genererade röntgenbilder skapade med ChatGPT och inkluderade röntgenbilder från olika delar av kroppen. Den andra uppsättningen fokuserade på bröströntgen, där hälften var verkliga och hälften genererade med RoentGen, en öppen diffusionsmodell utvecklad av forskare vid Stanford Medicine.

När radiologerna inte fick veta att förfalskade bilder ingick, identifierade de de AI-genererade röntgenbilderna i 41 % av fallen. Efter att ha informerats om att syntetiska bilder förekom, ökade deras genomsnittliga träffsäkerhet i att skilja verkliga från falska bilder till 75 %.

Prestationen varierade kraftigt mellan individerna. Radiologerna identifierade korrekt mellan 58 % och 92 % av de ChatGPT-genererade bilderna. För RoentGen-genererade bröströntgenbilder varierade radiologernas träffsäkerhet från 62 % till 78 %.

Forskarna testade också flera multimodala stora språkmodeller på samma uppgift. Fyra system – GPT-4o och GPT-5 från OpenAI, Gemini 2.5 Pro från Google och Llama 4 Maverick från Meta – uppnådde träffsäkerhet mellan 57 % och 85 %. Inte ens ChatGPT-4o, som användes för att generera några av deepfake-bilderna, upptäckte alla, även om den presterade bättre än de andra modellerna.

Studien fann inget samband mellan antalet års erfarenhet inom radiologi och förmågan att identifiera falska röntgenbilder, men rapporterade att muskuloskeletala radiologer presterade betydligt bättre än andra subspecialister.

Huvudförfattaren Mickael Tordjman, M.D., postdoktor vid Icahn School of Medicine vid Mount Sinai i New York, menar att resultaten pekar på sårbarheter inom både juridik och cybersäkerhet. ”Detta skapar en högriskutsatt sårbarhet för bedrägliga rättstvister om exempelvis en fabricerad fraktur skulle vara omöjlig att skilja från en verklig”, sade han, och tillade att det finns ”en betydande cybersäkerhetsrisk om hackare skulle få tillgång till ett sjukhus nätverk och injicera syntetiska bilder för att manipulera patientdiagnoser eller orsaka omfattande kliniskt kaos genom att undergräva den grundläggande tillförlitligheten i den digitala patientjournalen.”

Tordjman beskrev även visuella mönster som kan förekomma i syntetiska bilder och menar att medicinska deepfake-bilder kan se ”för perfekta” ut, med överdrivet jämna ben, onaturligt raka ryggrader, överdrivet symmetriska lungor, alltför enhetliga mönster i blodkärl och ovanligt rena frakturer.

För att minska risken för manipulation och felaktig attribuering rekommenderade forskarna säkerhetsåtgärder, inklusive osynliga vattenstämplar inbäddade direkt i bilderna och kryptografiska signaturer kopplade till röntgensjuksköterskan vid tidpunkten för bildtagningen. De uppgav även att de har släppt ett kurerat deepfake-dataset med interaktiva frågesporter avsedda för utbildning och medvetandegörande.

”Vi ser potentiellt bara toppen av isberget”, sa Tordjman och argumenterade för att AI-genererade 3D-bilder som CT och MRI kan bli nästa steg, och att verktyg för detektering samt utbildningsresurser bör utvecklas tidigt.