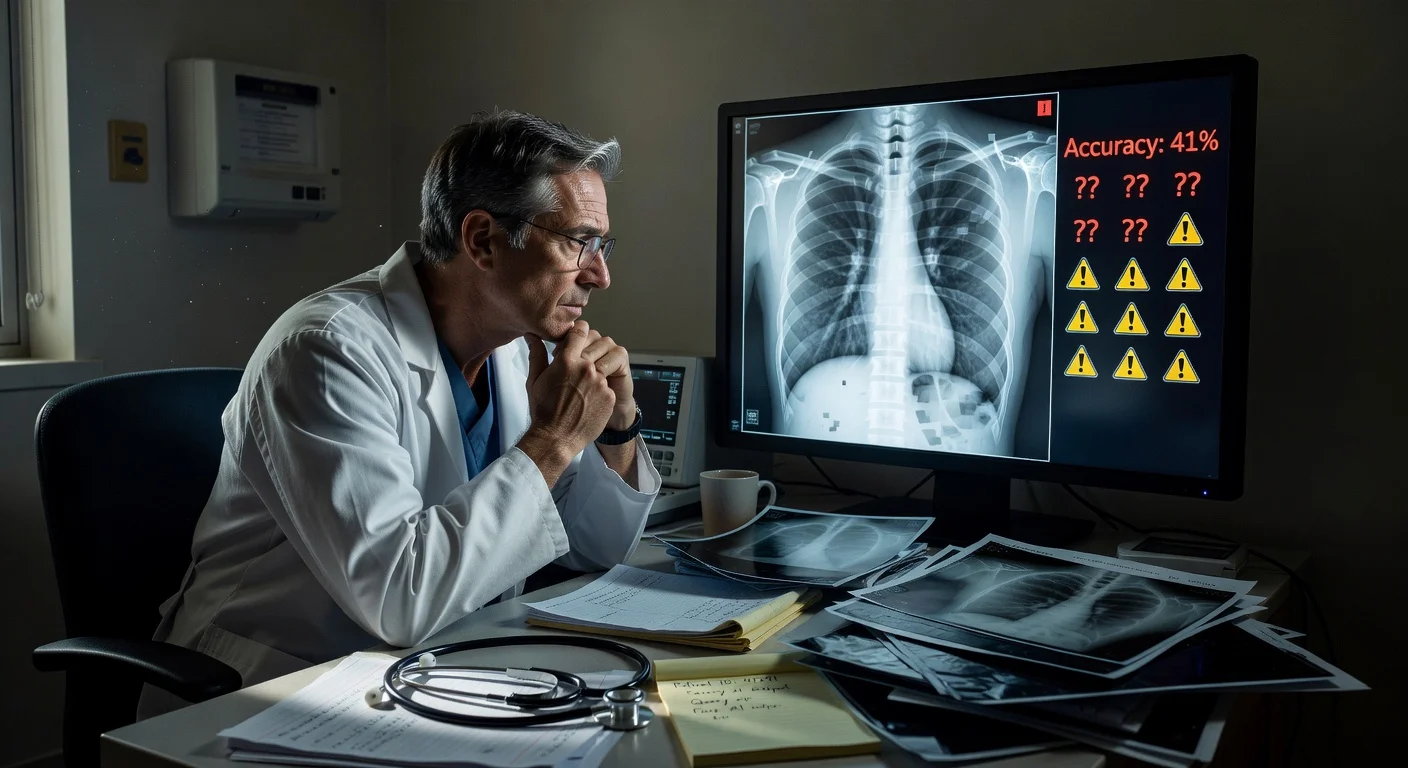

Sebuah studi yang diterbitkan pada 24 Maret 2026 di *Radiology* melaporkan bahwa rontgen "deepfake" buatan AI bisa cukup meyakinkan untuk mengecoh ahli radiologi dan beberapa sistem AI multimodal. Dalam pengujian, akurasi rata-rata ahli radiologi meningkat dari 41% saat mereka tidak diberi tahu adanya gambar palsu menjadi 75% saat mereka diperingatkan, yang menyoroti potensi risiko bagi keamanan pencitraan medis dan pengambilan keputusan klinis.

Para ahli radiologi dari 12 institusi di enam negara—Amerika Serikat, Prancis, Jerman, Turki, Inggris, dan Uni Emirat Arab—mengambil bagian dalam tes peninjauan gambar yang dijelaskan dalam sebuah studi yang diterbitkan pada 24 Maret 2026 di Radiology, jurnal dari Radiological Society of North America.

Studi tersebut melibatkan 17 ahli radiologi dengan pengalaman mulai dari pemula hingga dokter dengan masa praktik hingga 40 tahun. Mereka mengevaluasi 264 gambar rontgen yang dibagi rata antara pindaian asli dan gambar buatan AI.

Para peserta meninjau dua set gambar tanpa tumpang tindih. Satu set mencampurkan gambar asli dengan radiograf buatan AI yang dibuat menggunakan ChatGPT dan menyertakan rontgen dari berbagai bagian tubuh. Set kedua berfokus pada rontgen dada, dengan separuh asli dan separuh dibuat menggunakan RoentGen, sebuah model difusi sumber terbuka yang dikembangkan oleh para peneliti dari Stanford Medicine.

Saat para ahli radiologi tidak diberitahu bahwa gambar palsu disertakan, mereka mengenali rontgen buatan AI sebesar 41% dari waktu pengujian. Setelah mereka diinformasikan bahwa terdapat gambar sintetis, akurasi rata-rata mereka dalam membedakan antara gambar asli dan palsu meningkat menjadi 75%.

Kinerja sangat bervariasi antar individu. Ahli radiologi mengidentifikasi dengan benar antara 58% hingga 92% gambar yang dibuat oleh ChatGPT. Untuk rontgen dada buatan RoentGen, akurasi ahli radiologi berkisar antara 62% hingga 78%.

Para peneliti juga menguji beberapa model bahasa besar multimodal pada tugas yang sama. Empat sistem—GPT-4o dan GPT-5 dari OpenAI, Gemini 2.5 Pro dari Google, serta Llama 4 Maverick dari Meta—mencapai tingkat akurasi mulai dari 57% hingga 85%. Bahkan ChatGPT-4o, yang digunakan untuk menghasilkan beberapa gambar deepfake, tidak mendeteksi semuanya, meskipun kinerjanya lebih baik daripada model lainnya.

Studi tersebut tidak menemukan hubungan antara lamanya pengalaman radiologi dengan kemampuan mengidentifikasi rontgen palsu, tetapi melaporkan bahwa ahli radiologi muskuloskeletal berkinerja jauh lebih baik daripada subspesialis lainnya.

Penulis utama Mickael Tordjman, M.D., seorang rekan pascadoktoral di Icahn School of Medicine at Mount Sinai di New York, mengatakan hasil tersebut menunjukkan adanya kerentanan hukum dan keamanan siber. "Ini menciptakan kerentanan berisiko tinggi untuk litigasi penipuan jika, misalnya, patah tulang yang direkayasa tidak dapat dibedakan dari yang asli," ujarnya, seraya menambahkan bahwa ada "risiko keamanan siber yang signifikan jika peretas mendapatkan akses ke jaringan rumah sakit dan menyuntikkan gambar sintetis untuk memanipulasi diagnosis pasien atau menyebabkan kekacauan klinis yang luas dengan merusak keandalan mendasar dari rekam medis digital."

Tordjman juga mendeskripsikan pola visual yang mungkin muncul pada gambar sintetis, dengan mengatakan gambar medis deepfake bisa terlihat "terlalu sempurna," dengan tulang yang terlalu halus, tulang belakang yang lurus secara tidak alami, paru-paru yang terlalu simetris, pola pembuluh darah yang terlalu seragam, dan patah tulang yang tampak terlalu bersih.

Untuk mengurangi risiko manipulasi dan salah atribusi, para peneliti merekomendasikan perlindungan termasuk tanda air tak terlihat yang disematkan langsung ke dalam gambar dan tanda tangan kriptografis yang terkait dengan teknolog pencitraan pada saat pengambilan gambar. Mereka juga mengatakan telah merilis dataset deepfake terkurasi dengan kuis interaktif yang ditujukan untuk pelatihan dan peningkatan kesadaran.

"Kita mungkin baru melihat puncak gunung es," kata Tordjman, seraya berpendapat bahwa gambar 3D buatan AI seperti CT dan MRI bisa menjadi langkah selanjutnya sehingga alat deteksi dan sumber daya edukasi harus dikembangkan sejak dini.