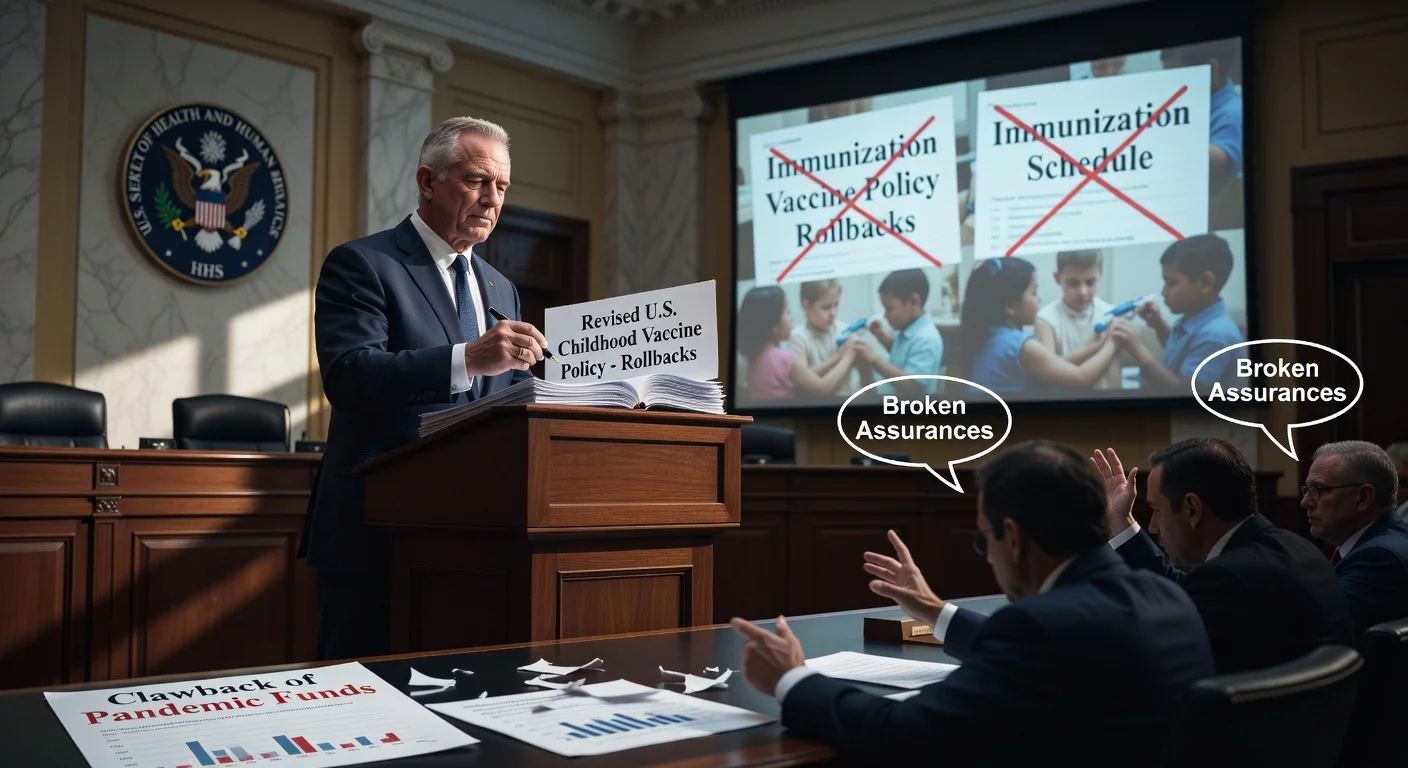

Le département américain de la Santé et des Services sociaux crée un outil d'IA générative pour analyser les réclamations de blessures vaccinales. L'outil vise à identifier des schémas dans une base de données nationale de surveillance et à générer des hypothèses sur les effets secondaires des vaccins. Les experts expriment des préoccupations quant à son utilisation potentielle sous la direction de Robert F. Kennedy Jr.

Le département américain de la Santé et des Services sociaux (HHS) a annoncé le développement d'un outil d'intelligence artificielle générative axé sur les données liées aux vaccins. Selon un inventaire publié la semaine dernière détaillant tous les cas d'utilisation de l'IA pour l'agence en 2025, l'outil examinera les rapports soumis à une base de données nationale de surveillance des vaccins. Ses fonctions principales incluent la détection de schémas dans les données et la production d'hypothèses concernant les effets négatifs des vaccins. Cette initiative intervient dans le cadre de discussions plus larges sur les applications de l'IA en santé publique. L'inventaire, qui décrit les déploiements prévus de l'IA par le HHS pour l'année prochaine, met en lumière cet outil comme faisant partie des efforts pour améliorer l'analyse des données dans la surveillance de la sécurité des vaccins. Cependant, le projet a suscité l'alarme parmi les experts, qui craignent que, sous l'influence de Robert F. Kennedy Jr., récemment associé au département, l'IA puisse être orientée pour soutenir des perspectives antivaccinales. Kennedy est un critique virulent des vaccins depuis longtemps, et les critiques redoutent que l'outil amplifie des allégations non fondées sur les blessures vaccinales. Ce développement reflète l'intégration croissante de l'IA dans les opérations de santé gouvernementales, mais souligne également les tensions entre l'innovation technologique et la confiance du public dans les programmes de vaccination. À la date de publication de l'inventaire, aucun calendrier spécifique pour le déploiement de l'outil n'a été détaillé au-delà du cadre 2025. Les défenseurs de la santé publique insistent sur la nécessité d'une surveillance rigoureuse pour s'assurer que les sorties de l'IA restent basées sur des preuves et ne contribuent pas à la désinformation.