El Departamento de Salud y Servicios Humanos de EE.UU. está creando una herramienta de IA generativa para analizar reclamaciones de lesiones por vacunas. La herramienta busca identificar patrones en una base de datos nacional de monitoreo y generar hipótesis sobre efectos secundarios de las vacunas. Expertos expresan preocupaciones sobre su posible uso bajo el liderazgo de Robert F. Kennedy Jr.

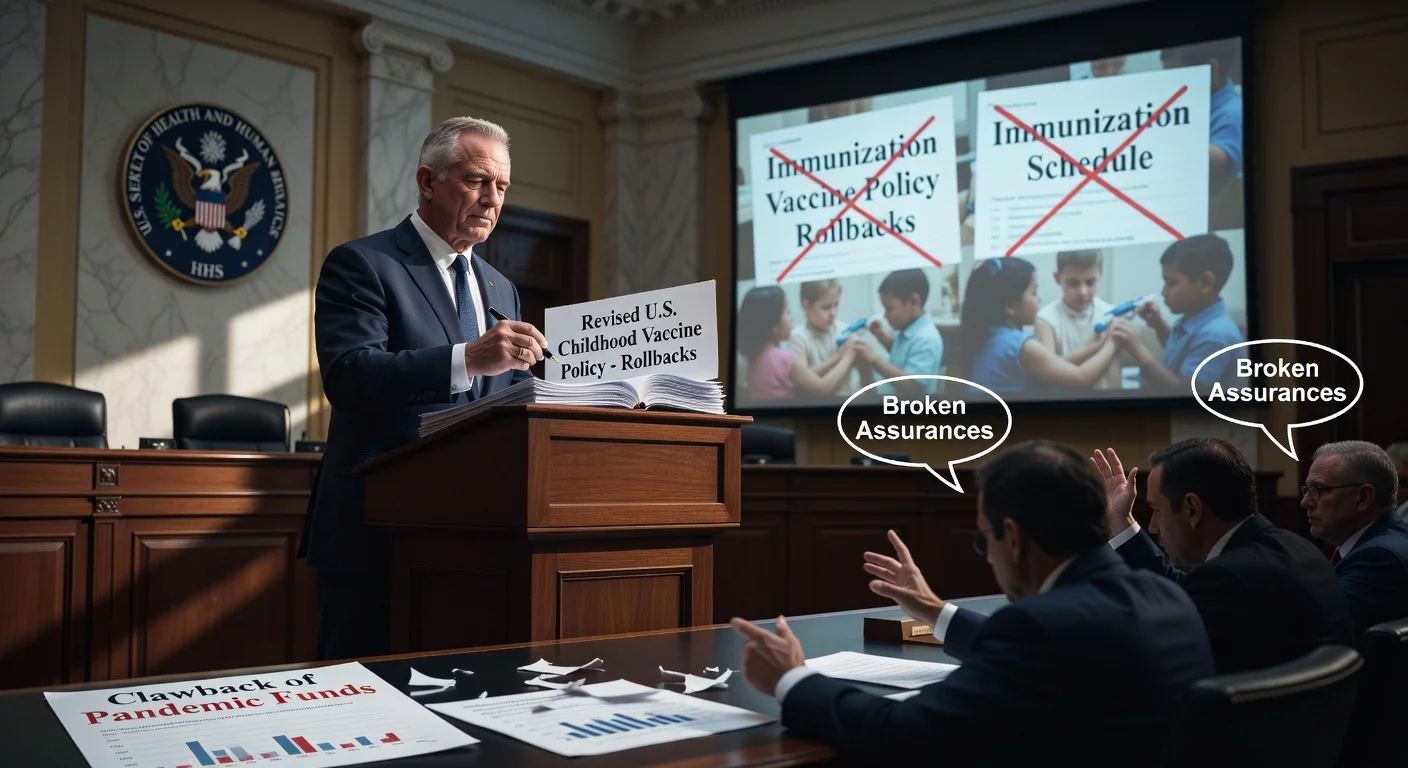

El Departamento de Salud y Servicios Humanos de EE.UU. (HHS) ha anunciado el desarrollo de una herramienta de inteligencia artificial generativa centrada en datos relacionados con vacunas. Según un inventario publicado la semana pasada que detalla todos los casos de uso de IA para la agencia en 2025, la herramienta examinará informes enviados a una base de datos nacional de monitoreo de vacunas. Sus funciones principales incluyen detectar patrones en los datos y producir hipótesis sobre los efectos negativos de las vacunas. Esta iniciativa surge en medio de discusiones más amplias sobre las aplicaciones de la IA en la salud pública. El inventario, que describe los despliegues planificados de IA de HHS para el próximo año, destaca esta herramienta como parte de los esfuerzos para mejorar el análisis de datos en el monitoreo de la seguridad de las vacunas. Sin embargo, el proyecto ha generado alarma entre expertos, que temen que bajo la influencia de Robert F. Kennedy Jr., recientemente asociado con el departamento, la IA pueda dirigirse a respaldar perspectivas antivacunas. Kennedy ha sido durante mucho tiempo un crítico vocal de las vacunas, y los críticos temen que la herramienta pueda amplificar afirmaciones no fundamentadas sobre lesiones por vacunas. El desarrollo refleja la creciente integración de la IA en las operaciones de salud gubernamentales, pero también subraya las tensiones entre la innovación tecnológica y la confianza pública en los programas de vacunación. Hasta el momento de la publicación del inventario, no se ha detallado un cronograma específico para el despliegue de la herramienta más allá del marco de 2025. Los defensores de la salud pública enfatizan la necesidad de una supervisión rigurosa para garantizar que las salidas de la IA sigan siendo basadas en evidencia y no contribuyan a la desinformación.