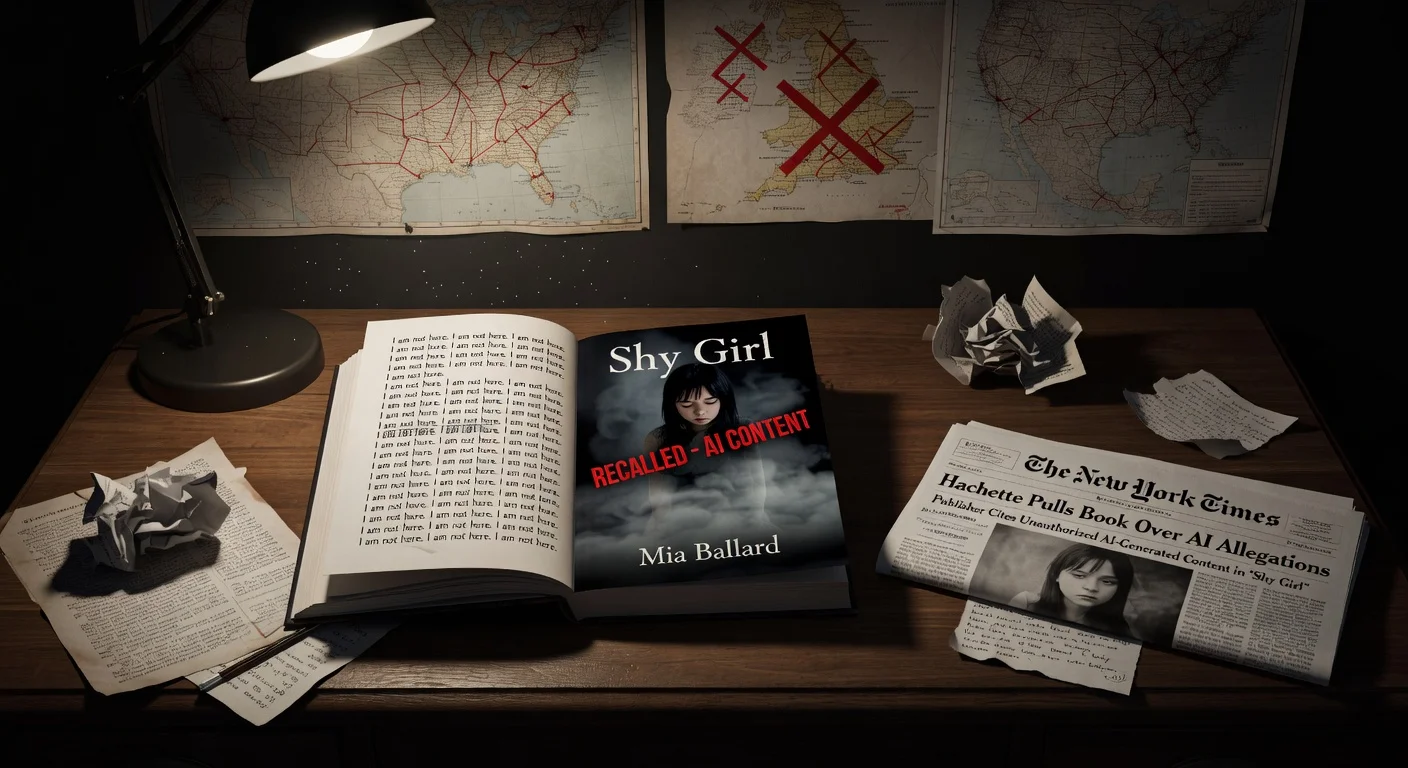

Hachette Book Group a annulé la sortie prévue aux États-Unis et interrompu l'édition britannique du roman d'horreur Shy Girl de Mia Ballard à la suite d'une enquête du New York Times faisant état d'un texte généré par l'intelligence artificielle. Le titre auto-publié a éveillé les soupçons des lecteurs en raison d'une prose répétitive et de schémas linguistiques. L'auteure Ballard nie avoir eu recours à l'IA à des fins personnelles, rejetant la faute sur un éditeur ou une connaissance, et affirme que le scandale a eu un effet dévastateur sur sa santé mentale.

Le roman d'horreur Shy Girl de Mia Ballard a été auto-publié en février 2025 et a fait le buzz sur les médias sociaux. La maison d'édition Orbit de Hachette l'a acquis en juin dernier en vue d'une publication traditionnelle, le publiant au Royaume-Uni en novembre 2025, le lancement aux États-Unis étant prévu pour le printemps 2026. Les lecteurs se sont rapidement inquiétés de la prose semblable à celle de l'IA, notamment des mots répétitifs tels que "edge" (84 fois) et "sharp" (159 fois), mis en évidence dans une vidéo YouTube de frankie's shelf qui a été visionnée 1,2 million de fois. En janvier 2026, un prétendu éditeur du livre a posté un message sur Reddit et l'outil de détection de l'IA de Pangram (dirigé par Max Spero) a estimé que le roman était généré à 78 % par l'IA, citant des schémas linguistiques, des lacunes logiques, des adjectifs mélodramatiques et un recours excessif à la règle de trois.

Jeudi, le New York Times a publié une enquête d'Alexandra Alter analysant des passages à l'aide d'outils de détection de l'IA, confirmant ces problèmes. Hachette a rapidement annulé la sortie du livre aux États-Unis, l'a retiré de son site web et a retiré l'édition britannique. Hachette s'est engagé à protéger l'expression créative et la narration originales", a déclaré l'éditeur, précisant que les auteurs devaient divulguer toute utilisation de l'IA.

Mme Ballard a déclaré au Times qu'elle n'avait pas personnellement utilisé d'outils d'IA et a suggéré qu'un ami ou un éditeur aurait pu le faire. Mon nom est ruiné pour quelque chose que je n'ai même pas fait personnellement", a-t-elle écrit, ajoutant que la controverse avait nui à sa santé mentale et qu'elle intentait une action en justice. C'est la première fois qu'un grand éditeur retire publiquement un titre en raison de soupçons d'IA.

L'incident souligne les défis croissants que pose l'essor de l'IA dans l'édition, en particulier dans l'autoédition, où les "erreurs d'IA" prolifèrent sur des plateformes telles qu'Amazon. Les experts soulignent la nécessité de mieux vérifier l'authenticité des auteurs.