En ny studie har visat att hjärnregioner som styr ansiktsuttryck hos makaker arbetar tillsammans på oväntade sätt och utmanar tidigare antaganden om deras arbetsfördelning. Forskare ledda av Geena Ianni vid University of Pennsylvania använde avancerade neurala inspelningar för att avslöja hur dessa gester kodas. Resultaten kan bana väg för framtida hjärna-datorgränssnitt som dekodar ansiktssignaler för patienter med neurologiska funktionsnedsättningar.

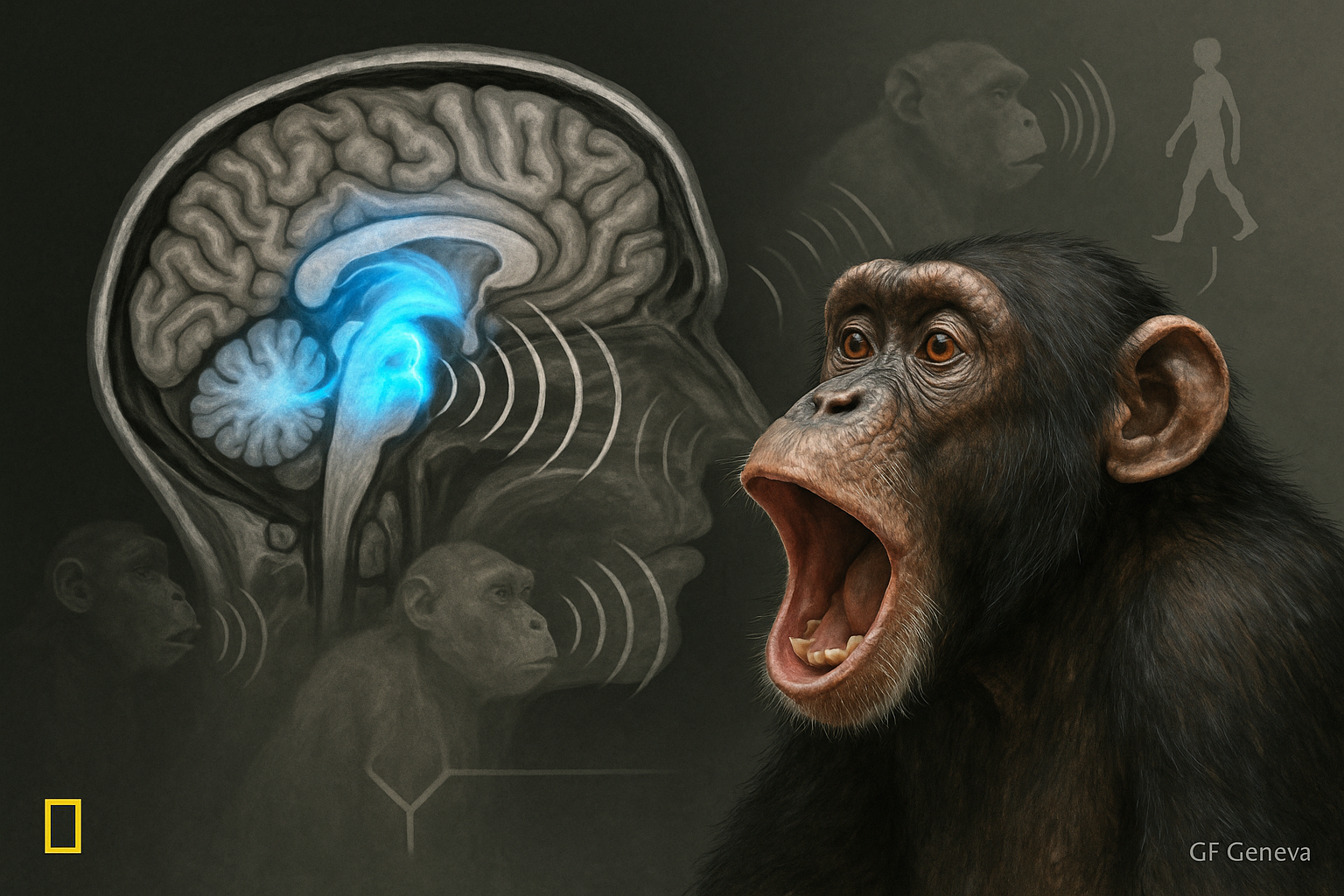

Neurovetenskapsmän har länge grubblat över hur hjärnan skapar ansiktsuttryck och antagit en tydlig uppdelning mellan områden som hanterar emotionella signaler och de som styr medvetna rörelser som tal. En studie publicerad i Science den 20 januari 2026 vänder dock upp och ner på detta genom experiment på makaker, primater med ansiktsmuskulatur liknande människans. Geena Ianni och hennes team vid University of Pennsylvania började med att skanna makakernas hjärnor med fMRI medan de filmade deras ansikten under sociala interaktioner. Djuren tittade på videor av andra makaker, interaktiva avatarer eller levande kamrater, vilket framkallade naturliga uttryck som läppsmakande för att visa underkastelse, hotfulla ansikten för att avskräcka rivaler och neutral tuggning. Med dessa skanningar identifierade forskarna nyckelområden i hjärnan: primära motorcortex, ventral premotorcortex, primära somatosensoriska cortex och cingulär motorcortex. De implanterade sedan mikroelektrodarrayer med submillimeterprecision i dessa regioner – det första försöket att registrera flera neuroner under produktion av ansiktsgester. Till skillnad från förväntningarna aktiverades alla fyra områden för varje gest, från sociala signaler till tuggning, i ett koordinerat mönster. «Vi förväntade oss en uppdelning där cingulära cortex styr sociala signaler medan motorcortex är specialiserad på tuggning», noterade Ianni, men data visade annat. Ytterligare analys avslöjade distinkta neurala koder. Cingulära cortex använder ett statiskt mönster som kvarstår i upp till 0,8 sekunder och troligen integrerar social kontext och sensorisk input. Däremot använder motor- och somatosensoriska cortex dynamiska koder med snabbt skiftande avfyrningshastigheter för att styra precisa muskelrörelser, som subtila läppryckningar. «Statiskt betyder att neuronernas avfyrningsmönster är beständigt över flera repetitioner... och över tid», förklarade Ianni och antydde att det stabiliserar gestens avsikt medan dynamiska områden utför detaljerna. Detta grundläggande arbete, beskrivet i tidskriften (doi.org/10.1126/science.aea0890), lägger grunden för neurala proteser som återställer ansiktskommunikation hos patienter med stroke eller förlamning. Ianni är optimistisk: «Jag hoppas att vårt arbete leder till att möjliggöra... mer naturalistiska och rika kommunikationsdesigner som förbättrar liv.» Ändå varnar hon för att pålitliga enheter är år bortom, liknande tidig taldekodningsteknik från 1990-talet.